「ok 丘比特,你大事不妙」:交友软件未经用户同意使用 300 万张用户照片用于训练 AI,却没被罚款

注册交友软件时,您就知道自己是在冒风险:无处不在的骗子和各种听说的不愉快的“艳遇”。而且光是使用这些应用,就会让您更容易遭遇安全和隐私问题,您的数据可能被收集并用于破解密码、盗号、照片被盗用于创建虚假档案等目的… 但说到底,这些风险是您自己选择承担的。这是交易的一部分。

然而,一家约会平台将您的敏感信息、照片和位置数据分享给您从未听说过的某家 AI 公司,并且未经您的同意,这就不像是交易的一部分了。这逾越了底线,构成了对信任的背叛。而 OkCupid,这家由 Match Group(旗下还拥有 Tinder、Hinge 和 Plenty of Fish)拥有的约会应用,正是这样做的。

更糟糕的是,事情被曝光后,它受到的惩罚只是蜻蜓点水。

当用户数据被视为公司财产

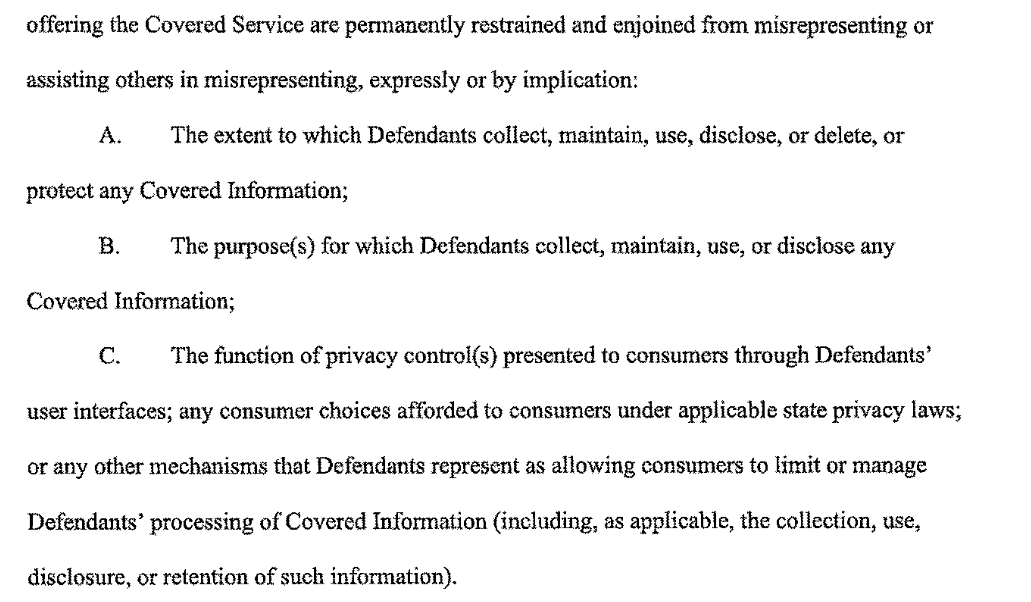

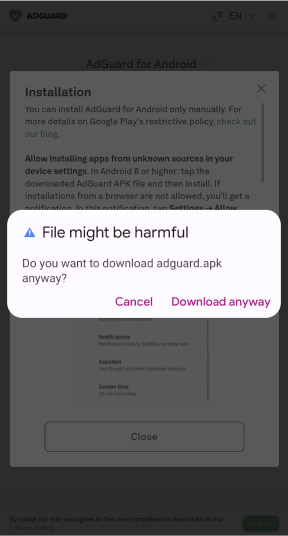

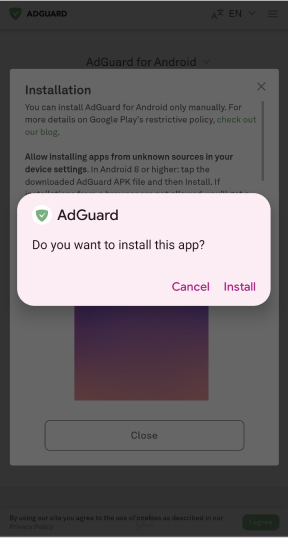

今年 3 月,OkCupid 及其母公司 Match Group 与美国联邦贸易委员会(FTC)达成了一项拟议和解。政府指控该应用「欺骗」用户,将包括照片和位置数据在内的个人信息分享给了一个无关的第三方。这一切都是在用户不知情或未经同意的情况下进行的,并且违反了 OkCupid 自身的隐私承诺。

早在 2014 年,在违规发生时,OkCupid 的隐私政策规定,它只能与「服务提供商」、商业伙伴或关联公司分享用户数据,或者只有在明确告知用户并让他们有机会选择退出后才能分享。但事实并非如此。FTC 发现 OkCupid 将数百万用户的信息(包括多达 300 万张用户照片)分享给了一家名为 Clarifai 的 AI 公司。这家公司既不是服务提供商、合作伙伴,也不是关联公司,而 OkCupid 从未征求用户同意,也没有给他们任何选择退出的机会。实际上,这让数百万用户完全不知道自己的数据正在幕后被挪作他用。

这是如何发生的,又为什么发生?解释相当平淡。OkCupid 的创始人在 Clarifai 拥有既得利益,后者后来利用这 300 万张照片和其他用户数据开发面部识别和图像处理工具。也就是说,他们投资了这家公司,并把 OkCupid 当成了一个方便的数据源。正如 Ars Technica 所报道,Clarifai 的 CEO 承认这些数据帮助他们构建了一个能够「识别检测到的人脸的年龄、性别和种族」的系统——这意味着用户的照片变成了他们从未同意支持的训练材料。FTC 指出,多年来 OkCupid 一直试图否认与该 AI 公司有任何关系。

从纸面上看,在措辞模糊的政策下,这或许可以被包装成可接受的行为。但实际上,OkCupid 对待用户数据的方式就像这些数据本就属于他们自己。这违背了他们所作出的隐私承诺的精神。因为政策所暗示的、以及用户合理相信的是,他们的数据只会以明确描述的方式被使用。而训练 AI 模型从来不是其中一部分。

要看出这种行为有多“构成问题”,不妨做一个简单的思想实验:假设创始人投资的不是一家 AI 公司,而是一家汽车保险经纪人或健康保险公司,然后随意让这个完全无关的企业访问通过 OkCupid 收集的敏感用户数据。这些数据随后可能被用来推断人们的生活方式、性取向或健康风险,进而影响他们的保险费率或投保资格。换句话说,基于用户从未有意为此目的分享的数据,给他们带来现实世界的负面影响。

处罚只是蜻蜓点水

您可能会认为,如此恶劣的用户数据处理不当会招致严厉处罚。但事实并非如此。作为和解的一部分,OkCupid 基本上只是被禁止在未来歪曲其数据收集实践和隐私控制措施。没有任何罚款也没有除合规义务之外任何真正长期后果。理论上,受影响的人仍然可以尝试在民事法庭起诉,但这希望渺茫,尤其是因为 Match 并未承认任何不当行为。

这种惩罚很难让人认真对待。实际上,这根本不算惩罚,只是对规则的再次重申。这基本等同于被告知不要做那些他们本来就不该做的事情。这让整件事感觉不像执法,更像是在拉钩承诺。而考虑到这家公司已经表现出在利于自己时愿意延伸甚至忽略自身承诺,这种处理方式实在难以令人信服。

未经同意分享用户数据:不是例外,而是常态

OkCupid 的案例只是这种对用户数据占有欲态度的最新例证。虽然有些人(包括 Match Group 在内)认为时代已经改变,这种宽松的做法早已成为过去,但事实远非如此。近年来,公司不当处理用户数据,常常是在未经明确同意的情况下悄悄分享或直接出售,的案例层出不穷。

以 Grindr 为例。近年来,该应用被发现未经有效同意与数百家广告合作伙伴分享高度敏感数据,包括性取向、精确位置和广告标识符,导致在挪威被罚款 610 万美元,并在英国因涉嫌与广告公司分享 HIV 相关数据而面临大规模法律行动。

又或者另一款约会应用 Raw,在 2025 年,一次安全漏洞暴露了用户的精确街道级位置以及性取向、出生日期等个人信息。这种暴露不仅会带来在线风险,还可能转化为现实世界的脆弱性。更添反乌托邦色彩的是,事件发生时,该公司正在探索制造一种可穿戴设备,用于监测伴侣的生理信号,这引发了对已经摇摇欲坠的数据实践之上又叠加监控的明显担忧。

而且这不仅仅是约会应用的问题。2024 年至 2025 年间,通用汽车及其 OnStar 部门被发现悄悄收集详细的驾驶行为数据,包括刹车、速度和位置信息,随后将这些数据出售给数据经纪商,再由保险公司用来提高保费,有些案例中涨幅惊人。再次强调,这对用户产生了现实世界的财务影响。FTC 最终在调查后禁止该做法五年。

类似模式在其他地方也出现过,从 LinkedIn 等社交平台到数据经纪商,甚至安全软件。在所有这些案例中(还有更多等待被发现),用户数据都是在人们毫不知情的情况下被悄悄挪作他用、分享或出售。如果说这些案例证明了什么,那就是「隐私承诺不过是空话」这种想法从未真正消失。

这对用户究竟意味着什么

人们很容易将这些案例视为抽象的违规行为或监管问题,但其后果绝非抽象。当这类数据被分享、泄露或挪作他用时,可能会暴露极为私人的信息:从性取向和健康状况到精确的位置历史,而且常常流向用户从未知晓的第三方。

这可能导致从定向操纵和用户画像到现实世界的风险,如骚扰、歧视或财务处罚(正如保险数据案例所示)。而一旦数据流出,就没有真正的方法可以收回或控制其后续使用方式。随着越来越多的系统开始依赖收集这类数据,风险只会越来越高。

这在年龄验证等较新的实践中变得尤为清晰。年龄验证在全球范围内日益普及,通常要求用户交出高度敏感的信息,例如面部扫描或政府颁发的身份证件。

风险越高,问题越大

因此,尽管风险和担忧并不新鲜,但情况正变得越来越危险。以英国年龄验证领导者 Yoti 为例,该公司最近被发现未经有效同意收集并保留生物特征数据,或者 Discord,它推出了基于身份证的年龄验证,随后这些数据在泄露事件中被曝光。在这两个案例中,用户都被要求交出高度敏感的数据,结果却被不当处理或暴露。

整个世界正朝着为追求便利而收集更多数据的方向发展。我们越来越多地被基于同样前提的技术所包围,从 Ring 等家庭监控系统到 Flock 等城市级跟踪网络,后者使用 AI 驱动的摄像头将车牌和车辆详细信息记录到可搜索的数据库中。

尽管这些创新被吹捧为安全的福音,但它们都带有同一个根本性的问题。你必须祈祷这些系统不会被黑客入侵,同时还要相信公司不会滥用你的数据。但我们已经目睹了这两者都曾发生,而且往往用户毫不知情。即使政策听起来让人放心,组织内部总有有权访问的人,只需要一次滥用或一匹害群之马就够了。

这就是为什么大规模数据收集、行为跟踪或始终在线的监控(无论它们被包装为安全、个性化还是创新)越来越不像功能,而更像负担。因为当问题发生时,承受后果的是用户,而不是收集数据的公司。我们被期望相信公司会做正确的事,并寄希望于当它们没有做到时有人能抓住它们(如果你幸运的话)。也许情况一直如此。但只要没有真正的后果(正如 OkCupid 案例所显示的)它们下次几乎没有任何动力做出改变。