回不去了:三星 ChatGPT 惨败凸显了人工智能的隐私问题

据韩国媒体《Economist》报道,三星起初对采用人工智能驱动的聊天机器人持谨慎态度,担心有泄露内部信息的危险,如商业机密(真有道理)。然而,在 ChatGPT 火爆全球的时候,三星决定加入 AI 聊天机器人的行列,并为其在工作场所的使用打开了绿灯,以便员工能够保持对技术改进的关注。当时,该公司向计划使用 ChatGPT 的员工发出通知,在向 AI 助手投喂数据时,“注意内部信息的安全,不要输入私人信息”。

这一通知显然被置若罔闻,因为在接下来的20天内,不是一位,而是三位公司的工程师透露了似乎是三星的敏感企业数据,可能让 OpenAI 及其竞争对手了解到其技术。

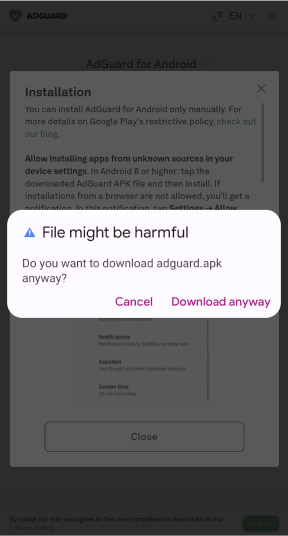

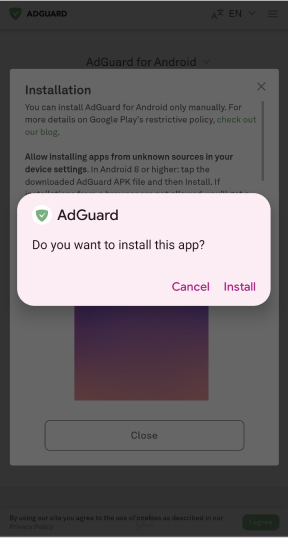

在第一个案例中,一位三星员工发现了半导体工厂测量数据库下载程序源代码中的一个错误,并询问 ChatGPT 能否提供解决方案。在第二个案例中,一位员工使用 ChatGPT 来优化一个识别产量和缺陷芯片的程序的测试顺序。在第三个案例中,一位员工首先用手机记录了公司的内部会议,然后用语音识别应用程序转录,并将其输入 ChatGPT… 以生成会议记录。这三人现在都面临着纪律调查。

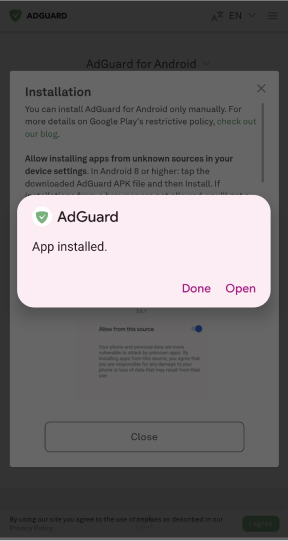

有用户可能认为,三星在泄露事故后要立即禁止 ChatGPT 的使用,但事实并非如此。相反,三星公司让员工多了解人工智能的隐私风险,向员工解释道,无论你向 ChatGPT 输入什么内容,其都最终都会传送到 OpenAI 的外部服务器上。这意味着,一旦员工泄露秘密,就没有回头路了,没有办法检索输入的数据。三星还制定相关保护措施,对每位员工上传到 ChatGPT 的数据量设置上限,并警告说,如果再次发生泄露数据的事件,公司将永远禁止 ChatGPT。

传给 ChatGPT 的消息可撤回不了

三星不是第一个,而只是其员工喜欢与 OpenAI 的聊天机器人讨论敏感问题的最新受害者。其他公司也在摸索这条路。

Amazon 在1月份就限制了 ChatGPT 的访问,警告员工不要向聊天机器人输入任何机密资料,例如代码,因为该公司发现 ChatGPT 的回复中生成了与 Amazon 内部数据“密切匹配”的回答。另一家美国零售巨头 Walmart 在发现 ChatGPT 的活动“给公司带来风险”后,最初将其封锁,但后来开放使用并发布了一系列准则,包括员工应“避免输入任何敏感、保密或专有信息”。

一些金融服务公司已经在工作场所完全禁止了 ChatGPT。美国银行将 ChatGPT 添加到其不允许用于商业用途的未经授权的应用程序列表中。其他阻止访问聊天工具的金融机构包括JPMorgan Chase、Citigroup Inc、Goldman Sachs、Deutsche Bank 和 Wells Fargo。后者告诉 《Bloomberg》,这符合标准的第三方软件限制,该公司将"继续评估安全和有效的方式"来使用新技术。

银行业在应对与 ChatGPT 相关的风险方面最为积极,这也是可以理解的:银行处理大量敏感的客户信息,并受到高度监管。但其实各种其他行业也面临同样的风险。一旦你给了聊天机器人一条信息,不管是一段私人代码还是董事会会议的记录,都要意识到,这个内容不再是一个秘密,而是公共分享的资料。

OpenAI 的使用条款暗示,在与聊天机器人互动时,用户不应该有任何隐私的期望,并要求用户负责不泄露个人信息。特别是,OpenAI 表示,公司可以查看并使用 ChatGPT 对话来训练人工智能,但不能帮助用户从聊天记录中删除特定的记录。

这意味着,如果你在 ChatGPT 输入关于自己或公司的机密信息,其他人有可能向 ChatGPT 索取并占有这些数据。在三星的案例中,该公司的竞争对手可以尝试审问聊天机器人,了解公司员工允许泄露的信息。

OpenAI 确实允许了用户禁止个人数据被用于人工智能训练,为此用户需要填写一份特殊的表格。然而,如果你已经与 ChatGPT 分享了一些数据,而你又后悔分享这些数据,那么现在可能已经太晚了。你可能要考虑删除自己的账户,因为只有在这种情况下,你的聊天记录才能被永久删除。OpenAI 声称,删除数据的过程可能需要30天,而且删除后你将无法恢复账户。

但之后会发生什么是个大问题,因为用户通常不知道他们的信息是如何被用来训练算法的,也无法验证这些信息是否已经被删除。虽然理论上有可能让一个系统忘记它所学到的东西,但这个过程被认为是非常复杂的,尤其是因为它需要确定特定数据点对训练过的模型的影响。虽然在对生成性人工智能的安全和隐私影响的日益关注中,有关于所谓的机器学习的研究,但这是最需要努力的领域。普遍的观点似乎是要从头开始重新训练整个模型,这在实践中是不可行的。

因此,如果我们不能确定我们交给 ChatGPT 的信息会消失,即使在我们使用了所有可用的选项之后,最好还是不要把我们或我们公司的内部秘密交给 AI 助手。谁知道他们最终会传送哪里。正如 OpenAI 自己所说:“请不要分享敏感信息”。这是值得牢记于心的。