El fin de Genesis, OpenAI en apuros, Google copia a Apple y más en el resumen de AdGuard

En esta edición del resumen de AdGuard: ChatGPT se enfrenta a su primera demanda por difamación y otras cuestiones normativas; aumento de la venta de credenciales robadas en el mercado negro de Internet; las plataformas de apoyo para la recuperación de alcoholismo filtran datos a los anunciantes; y Google da a los usuarios más control sobre sus datos almacenados en el sistema.

Italia ha puesto condiciones para el regreso de ChatGPT, y todas tienen que ver con la privacidad

Italia ha dado a OpenAI, la empresa estadounidense detrás de ChatGPT, una lista de exigencias que deben cumplir si quieren que su popular chatbot no sea prohibido en el país. ChatGPT tiene bloqueado el acceso en Italia desde el 31 de marzo, después de que el organismo regulador local lo acusara de violar la ley de protección de datos GDPR de la UE.

Ahora, el organismo regulador italiano ha elaborado una lista de condiciones y medidas que debe adoptar OpenAI para que ChatGPT cumpla la ley. Las exigencias incluyen que OpenAI establezca una base legal para procesar los datos de los usuarios que se utilizarán para entrenar sus algoritmos de IA, así como que ofrezca a los usuarios una forma de corregir cualquier información falsa que el chatbot haya difundido sobre ellos o, si esto es "técnicamente impracticable", que garantice la eliminación de estos datos. También se exigía que tanto los usuarios como los no usuarios tuvieran derecho a oponerse al uso de sus datos para el entrenamieno de la IA. Por último, el regulador italiano también exigió a OpenAI que implantara un sistema de verificación de la edad que impidiera a los usuarios menores de 13 años acceder al chatbot.

Pero no sólo Italia está poniendo a prueba OpenAI: en la Unión Europea se ha creado un grupo especial para ayudar a los Estados miembros a alinear sus posturas sobre ChatGPT.

Será interesante ver cómo y si OpenAI puede superar el obstáculo del GDPR, ya que las herramientas basadas en IA, incluido ChatGPT, presentan un riesgo inherente para la privacidad. Los modelos de IA en los que se basan ChatGPT y otras herramientas de IA como DALLE-E se han entrenado a partir de grandes cantidades de datos extraídos de Internet sin el consentimiento de los usuarios. Aunque es posible optar por no eliminar tus datos del conjunto de entrenamiento de ChatGPT y borrar tu cuenta, pedir a una Inteligencia Artificial que "desaprenda" algo es un proceso muy complejo. Además, no hay forma segura de saber que tus datos se han eliminado realmente de forma permanente. De todos modos, si Italia y OpenAI pueden llegar a un acuerdo y resolver estos problemas, la situación puede servir de ejemplo para otros países en los que se aplica el GDPR.

¡Nos vemos en los tribunales! Un alcalde alega haber sido difamado por ChatGPT

Por ahora, sin embargo, ChatGPT está en la cuerda floja, enfrentándose cada día a más desafíos legales. No es ningún secreto que los grandes modelos lingüísticos pueden "alucinar", es decir, difundir información errónea o incluso "inventarse" hechos. Al parecer, esto es lo que ha ocurrido en el caso de un alcalde australiano que puede presentar la primera demanda por difamación contra OpenAI. El funcionario afirma que ChatGPT afirmó falsamente que había cumplido condena por soborno, dañando así su reputación. De hecho, fue el alcalde quien denunció la trama de sobornos y nunca fue acusado de ningún delito. El equipo jurídico del alcalde ha dado a OpenAI 28 días para corregir el error o enfrentarse a acciones legales. El alcalde podría recibir hasta 200.000 dólares por daños y perjuicios si cumple su amenaza de demandar a OpenAI.

OpenAI intentó eximirse de responsabilidad por las respuestas del chatbot advirtiendo que "a veces escribe respuestas plausibles pero incorrectas o sin sentido". Es difícil saber si el alcalde cumplirá su amenaza de demandar a OpenAI, pero si lo hace, estaremos muy atentos, ya que esto podría sentar un precedente para el futuro.

Sea cual sea el resultado, una cosa es cierta: a medida que la IA generativa se vuelve más hábil en la elaboración de respuestas creíbles y más personas la utilizan en el trabajo, la cuestión de quién debe responder por sus errores y cómo detener la propagación de información falsa es legítima.

Apps de apoyo al tratamiento del alcoholismo venden datos de los usuarios a los anunciantes

No hay nadie en quien confíes más que en tu médico, y difícilmente hay un momento más vulnerable que cuando estás luchando contra una adicción. Pero los 100.000 pacientes cuyos datos personales han sido filtrados por empresas como Monument y Tempest podrían pensárselo dos veces antes de confiar información confidencial a plataformas de salud en línea.

En una revelación de la que TechCrunch informó por primera vez, Monument, que adquirió Tempest en 2022, reveló que podría haber expuesto datos personales y de salud de pacientes a anunciantes como Facebook, Google, Microsoft y Pinterest. Los datos fueron revelados a los gigantes de la publicidad a través de píxeles de seguimiento incorporados en el sitio web de Monument desde 2020 y en el de Tempest desde 2017. La compañía dijo que eliminó por completo los rastreadores de terceros solo en febrero de este año. Los píxeles de seguimiento son fragmentos de código que los propietarios de sitios web pueden colocar en sus sitios para rastrear las acciones de los usuarios, lo que también ayuda a los anunciantes a medir el rendimiento de sus anuncios y orientarlos.

La información que puede haber sido compartida incluye: nombres de pacientes, fechas de nacimiento, direcciones de correo electrónico, números de teléfono, direcciones de casa, números de seguro e incluso información sensible como fotos, información relacionada con consultas, servicios seleccionados y respuestas a encuestas.

Evidentemente, los pacientes no consintieron que sus datos privados y regímenes de tratamiento se compartieran con la tecnología publicitaria. Este tipo de incidente dista mucho de ser aislado, y se vio en el caso de dos plataformas de salud mental que el mes pasado admitieron haber hecho lo mismo. Estas prácticas con los datos son terribles, lamentables y demasiado habituales. Si no tienes más remedio que confiar tus datos a proveedores de servicios de salud en línea, asegúrate de elegir proveedores reputados y dignos de confianza. Sin embargo, incluso esto puede no ser una garantía.

La operación "Cookie monster" acaba con un sitio que vendía credenciales robadas

El mercado Genesis, que solía ser un lugar conocido para la adquisición de credenciales robadas y huellas dactilares de navegación (para más información sobre lo que es una huella dactilar, lea nuestro artículo) ha quebrado gracias a un esfuerzo conjunto del FBI y de agencias de seguridad de todo el mundo.

El famoso mercado, al que sólo se podía acceder por invitación, fue desmantelado en la "Operación Cookie monster". La operación se saldó con la detención de 120 personas, entre ellas presuntos usuarios del sitio, y 200 registros en todo el mundo. Las autoridades tenían mucho interés en perseguir a los usuarios, no solo a los administradores del sitio: "Genesis prometió falsamente una nueva era de anonimato e impunidad, pero al final solo proporcionó una nueva forma de identificar, rastrear y detener a los delincuentes en línea" Desde su creación en 2018 y antes de su reciente desaparición, el mercado ofrecía acceso a aproximadamente 80 millones de credenciales de cuentas robadas, como nombres de usuario y contraseñas. Las huellas dactilares de dispositivos que también se ofrecían en el sitio permitían a los delincuentes eludir las protecciones antifraude.

La quiebra de Genesis es una buena noticia, pero no representa en absoluto el fin de la usurpación de identidad en Internet. El problema es que muchas personas permiten voluntariamente el acceso a sus informaciones sensibles, ya sea compartiéndolas en las redes sociales o entregándolas por descuido a terceros. Oversharing es un problema creciente, y nuestro interés es ir en contra de esta tendencia.

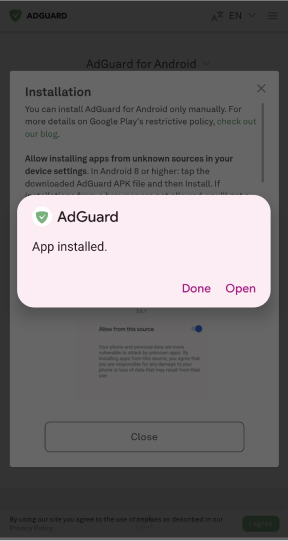

Google facilita la eliminación de los datos de tu cuenta y de tus aplicaciones

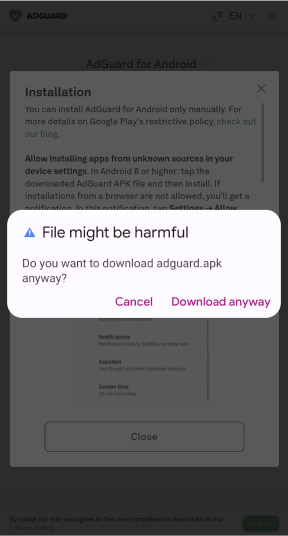

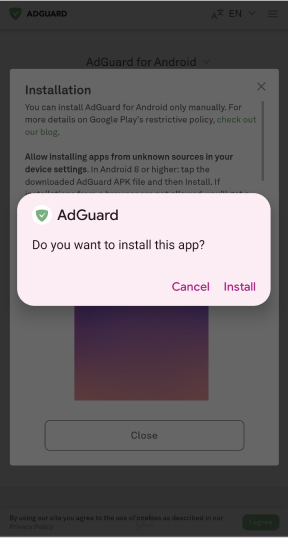

Google quiere que los desarrolladores de aplicaciones en su Play Store faciliten a los usuarios la eliminación de sus cuentas y datos asociados. Los usuarios deben poder hacerlo tanto dentro de la aplicación como en la web. Google afirma que, al aplicar esta política, está dando a los usuarios más control sobre sus datos en la app.

Con la norma en vigor, los usuarios no tendrán que volver a descargar la aplicación para solicitar la eliminación de su cuenta. Ellos podrán hacerlo a través de un enlace común a una página web. Cuando el usuario solicite la eliminación de su cuenta, los desarrolladores también tendrán que borrar todos los datos relacionados con esa cuenta, a menos que tengan "razones legítimas" para conservarlos. También tendrán que explicar cuáles son esas "razones legítimas", como la prevención del fraude. Los desarrolladores tienen hasta el 7 de diciembre de este año para proporcionar más información sobre sus prácticas de eliminación de datos, y los usuarios podrán ver los cambios el año que viene. La norma que introduce Google es similar a la que la App Store implantó en 2021. Apple exigía que las apps que permitían crear cuentas también dieran a los usuarios la opción de eliminarlas, pero solo desde la app.

Siempre es bueno que las grandes empresas tecnológicas como Google den a los usuarios cierto poder sobre sus datos personales, y lo único que lamentamos es que esto no haya ocurrido antes. Sin embargo, también hay que tener en cuenta que, a menos que haya una forma de verificar que los datos se han eliminado realmente, los desarrolladores de aplicaciones sin escrúpulos podrían seguir conservándolos.