Anthropic critica a ChatGPT y desata debate sobre anuncios en los chatbots

La noticia de que OpenAI introduciría anuncios en ChatGPT fue recibida con curiosidad, resentimiento y una persistente sensación de “ahí vamos otra vez…”. Después de anunciar el mes pasado que los anuncios llegarían al chatbot de IA de consumo más popular del mundo, OpenAI se apresuró a calmar las preocupaciones iniciales, asegurando a los usuarios que la publicidad no influiría en las respuestas de ChatGPT y que estaría claramente identificada como tal.

Se espera que los anuncios comiencen a mostrarse a los usuarios gratuitos y del plan más básico de ChatGPT en Estados Unidos en las próximas semanas —si no días. Algunos usuarios ya tuvieron un adelanto a través de una versión beta lanzada la semana pasada. En esa versión beta, los anuncios aparecen debajo de la ventana de respuesta y están claramente marcados como “patrocinados”. Son personalizados de forma predeterminada, con segmentación basada tanto en la conversación actual como en el historial de chats del usuario, a menos que este decida desactivar la personalización de anuncios. En ese caso, solo se utiliza el chat directamente relacionado con el prompt para la segmentación. OpenAI también enfatizó que no se venderán datos de los usuarios y que la experiencia publicitaria se mantendrá lo más integrada posible.

En el papel, estas garantías suenan bien, quizá incluso demasiado bien. La postura del CEO de OpenAI, Sam Altman, respecto a la publicidad ha cambiado con el tiempo: pasó de una autodeclarada aversión a los anuncios por una cuestión estética a una visión más pragmática de que pueden ser “buenos si se hacen de la manera correcta”. Tan solo eso ya hace difícil descartar un futuro en el que los anuncios se filtren en más partes de la experiencia con el chatbot. Y aunque eso podría no suceder pronto —o quizá nunca—, cuesta no imaginar lo fácil que sería que ocurriera.

La provocación de Anthropic es grosera, pero las preocupaciones son reales

Anthropic, rival de OpenAI fundada por exinvestigadores de la propia OpenAI y más conocida por su chatbot Claude, aprovechó el debate sobre los anuncios —y la forma en que decidió hacerlo dice mucho sobre lo intransigente que se ha vuelto la carrera armamentista de la IA.

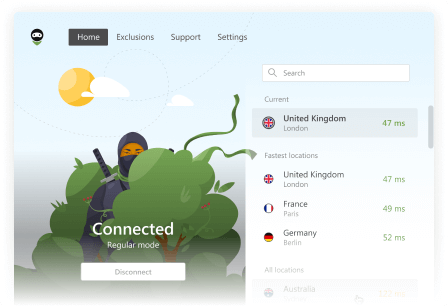

Escena de un anuncio de Anthropic. Fuente: Anthropic/YouTube

Anthropic publicó varios videos cortos, cada uno mostrando un escenario familiar en el que los usuarios recurren a chatbots en busca de ayuda: buscando consejos de entrenamiento, haciendo brainstorming de ideas de negocio, pidiendo ayuda con trabajos académicos o intentando mejorar la comunicación con un familiar.

Los videos, publicados en el canal de Anthropic en YouTube y programados para emitirse durante uno de los mayores momentos publicitarios del año —el Super Bowl, el 8 de febrero— siguen la misma estructura. Comienzan con un chatbot ofreciendo consejos que parecen razonables, atentos y genuinamente útiles, solo para descarrilar abruptamente hacia un anuncio completamente fuera de tono. Un entrenador personal que representa al agente de IA de repente empieza a recomendar plantillas que aumentan unos centímetros de estatura y ayudan a los “reyes bajitos” a parecer más altos. En otro video, el agente abandona el consejo empresarial para promocionar un servicio de préstamos dudoso. En otro más, un terapeuta que conversa con un usuario sobre su relación con su madre interrumpe la frase a la mitad para mostrar un anuncio de una app de citas donde puede conocer mujeres mayores.

Todos los videos terminan con la frase en pantalla: “Ads are coming to AI. But not to Claude”, al ritmo de “What’s the Difference”, de Dr. Dre. El anuncio tiene paralelismos inquietantes con el episodio “Common People”, de la serie Black Mirror, que imagina un mundo en el que un personaje sobrevive a un procedimiento cerebral experimental que le salva la vida, solo para descubrir que seguir con vida ahora requiere una suscripción mensual. A medida que los costos aumentan, es empujada a un plan con anuncios, lo que hace que comience a recitar publicidad de forma involuntaria en medio de conversaciones —a menudo de manera profundamente inapropiada, aunque teóricamente relacionada con el contexto. En un caso, un estudiante cuenta que sus padres están peleando y que su madre quiere dejar a su padre, y ella de pronto empieza a anunciar un sitio cristiano de asesoramiento familiar que anima a las familias a permanecer unidas. En otro, interrumpe un momento íntimo con su esposo para recomendar un gel contra la disfunción eréctil. La única forma de detenerlo es pagar por un plan sin anuncios, extremadamente caro. El episodio exagera el temor que Anthropic subraya: la monetización invadiendo momentos profundamente inapropiados y desconcertantes. Y, a diferencia de los anuncios tradicionales en motores de búsqueda, la sensación es mucho más personal cuando es un chatbot el que imita patrones de habla humanos.

Es una conversación que vale la pena tener. Después de todo, los chatbots se están convirtiendo rápidamente en parte de la vida cotidiana. Cada vez escuchamos más historias de personas que se vuelven dependientes de ChatGPT, de compañeros de IA que se convierten en sustitutos emocionales —incluso intereses románticos— y de bots conversacionales que funcionan como una especie de muleta cognitiva, ya que muchos ya no pueden imaginar su vida sin ellos.

Como señala Denis Vyazovoy, Head de Producto de AdGuard:

“Si los modelos publicitarios comienzan a integrarse de forma más profunda en los asistentes de IA, esto plantea una cuestión importante de confianza. Los usuarios no perciben estos servicios como plataformas de medios, sino como asistentes. Cualquier motivación comercial oculta, incluso en forma de recomendaciones, debe ser lo más transparente posible. El simple hecho de que grandes desarrolladores de IA estén debatiendo este tema demuestra que el mercado aún no ha definido los límites éticos de la monetización —y este es el momento ideal para tener esa conversación.”

En ese sentido, la IA empieza a parecerse a la computadora personal en sus inicios, cuando silenciosamente —pero de manera permanente— transformó la forma en que las personas trabajaban y pensaban. Por lo tanto, si los anuncios en agentes de IA realmente avanzan en la dirección contra la que advierte Anthropic, las señales de alarma deberían estar sonando.

“Doblepensar” engañoso: la respuesta de OpenAI

¿Pero realmente están sonando las alarmas? Por ahora, es difícil saberlo, ya que los anuncios en ChatGPT aún no se han lanzado de forma generalizada. Sam Altman respondió directamente a las provocaciones de Anthropic en una publicación en X, rechazando lo que calificó como una crítica engañosa.

“Me parece muy propio del doblepensar de Anthropic usar un anuncio engañoso para criticar anuncios teóricos engañosos que ni siquiera existen, pero no era en el Super Bowl donde esperaba ver esto”, dijo Altman.

Afirmó que ChatGPT jamás mostraría anuncios de la forma intrusiva retratada por Anthropic. Altman aprovechó para contrastar a ambas empresas, calificando a Anthropic de elitista por vender un producto caro y de nicho para un público pequeño y acomodado, mientras destacó el alcance democrático de ChatGPT, con acceso gratuito para miles de millones de personas y planes de pago opcionales y sin anuncios. “Más texanos usan ChatGPT gratis que el total de personas que usan Claude en Estados Unidos”, señaló. Altman también enmarcó el debate como una cuestión de control versus apertura. Mientras Anthropic bloquea a ciertas empresas para que no utilicen su producto de programación y se posiciona como árbitro de cómo debe usarse la IA, OpenAI presenta ChatGPT como una herramienta ampliamente accesible.

Paralelismos históricos: un camino ya recorrido

La competencia feroz genera publicidad agresiva. Anthropic no habría lanzado tales provocaciones —ni invertido dinero en uno de los espacios publicitarios más codiciados del mundo— solo por diversión. La empresa claramente puso mucho dinero sobre la mesa: un anuncio de 30 segundos en el Super Bowl cuesta más de 8 millones de dólares, y el comercial más largo emitido antes del partido, que muestra a un hombre pidiendo ayuda para comunicarse con su madre, tampoco debió ser barato.

Al ofrecer uno de los modelos de IA más caros del mercado (Altman no bromeaba cuando dijo que fue hecho para personas ricas), Anthropic ha sido considerada durante mucho tiempo la mejor opción para tareas especializadas —especialmente programación—. Pero, con OpenAI atrayendo talento de Anthropic y lanzando nuevos modelos a un ritmo acelerado —más recientemente el GPT-5.3-Codex—, no hay espacio para sentimentalismos. En esta carrera armamentista de la IA, todo vale: en el amor y en la guerra, todo se permite.

Anthropic también parece inspirarse claramente en la estrategia de Apple con su apuesta en el Super Bowl. Al igual que el icónico anuncio “1984”, que posicionó a Apple como la rebelde que desafiaba a la monolítica IBM, los anuncios de Anthropic fueron diseñados para generar impacto al ridiculizar a ChatGPT y retratar a Claude como la opción pura e imparcial. El impacto del anuncio de Apple en su momento fue inmediato y medible: se reporta que se vendieron alrededor de 3.5 millones de dólares en computadoras Macintosh poco después de su emisión.

La diferencia, por supuesto, es que ChatGPT se presenta como la alternativa democrática, mientras que Claude sigue siendo, al menos por ahora, un producto premium para unos pocos. Con esta campaña, Anthropic podría estar intentando cambiar esa percepción de una vez por todas. La gran pregunta es si esta estrategia funcionará o terminará volviéndose en su contra. Pero Anthropic también asume un riesgo considerable: si algún día decide introducir sus propios anuncios, podría encontrarse en el centro de una tormenta de relaciones públicas creada por ella misma.