OkCupid pas Ok : 3 millions de photos d'utilisateurs pour entrainer de l'IA, sans amende

Lorsque vous vous inscrivez sur une application de rencontres, le risque est assez évident. Vous vous exposez à des escrocs et à toutes sortes de mauvaises expériences dans un environnement très fréquenté. Le simple fait d’être présent sur ces applications vous rend plus vulnérable aux problèmes de sécurité et de confidentialité : vos données pourraient être collectées et utilisées pour pirater vos mots de passe, vos comptes détournés, vos photos volées et utilisées pour créer de faux profils… la liste est longue. Mais au final, ce sont des risques que vous choisissez de prendre. Ça fait partie du jeu.

En revanche, ce qui ne semble pas faire partie du jeu, c’est qu’une plateforme de rencontres partage vos informations sensibles, vos photos et vos données de localisation avec une entreprise d’IA dont vous n’avez jamais entendu parler, sans votre consentement. Cela dépasse les limites et constitue un abus de confiance. Mais c'est exactement ce qu'a fait OkCupid, une application de rencontre détenue par Match Group (qui est également propriétaire de Tinder, Hinge et Plenty of Fish).

Et pire encore, lorsque cela a été découvert, la sanction infligée n'a été guère plus qu'une simple tape sur les doigts.

Quand les données des utilisateurs sont considérées comme la propriété de l'entreprise

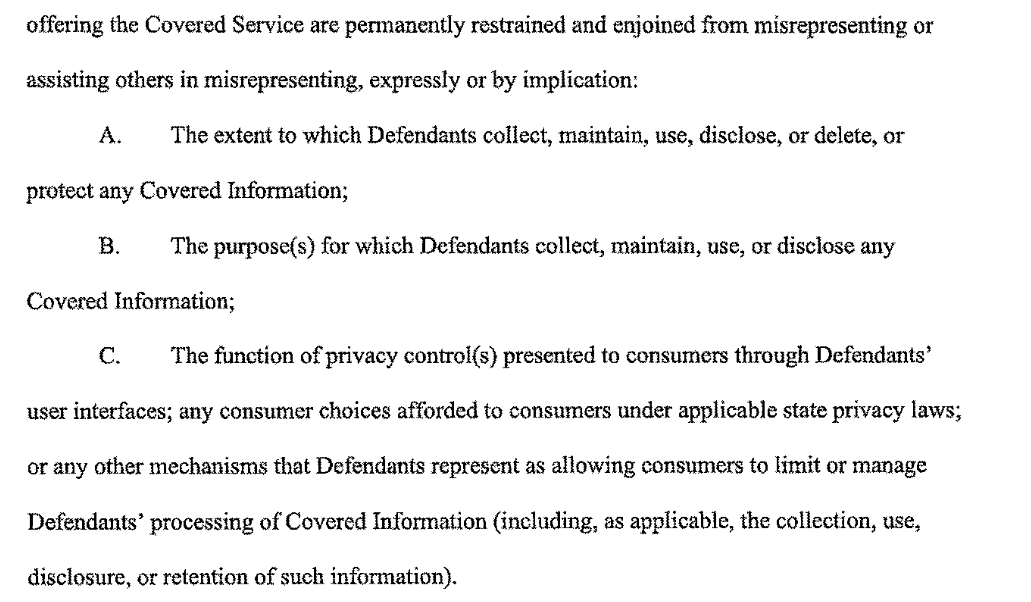

Dans le cadre d'un accord à l'amiable conclu en mars dernier entre OkCupid et sa société mère, Match Group, d'une part, et la Commission fédérale du commerce (FTC) des États-Unis, d'autre part, le gouvernement a allégué que l'application « trompait » les utilisateurs en partageant leurs informations personnelles — notamment des photos et des données de localisation — avec un tiers sans lien avec l'entreprise. Cela a été fait à l'insu et sans le consentement des utilisateurs, en violation des propres engagements d'OkCupid en matière de confidentialité.

Au moment de la violation — en 2014 —, la politique de confidentialité d’OkCupid stipulait que l’entreprise pouvait partager les données des utilisateurs soit avec des « prestataires de services », des partenaires commerciaux ou des sociétés affiliées, soit, dans le cas contraire, uniquement après en avoir explicitement informé les utilisateurs et leur avoir donné la possibilité de refuser. Mais ce n’est pas ce qui s’est passé. La FTC a constaté qu’OkCupid avait partagé les informations de potentiellement des millions d’utilisateurs, dont jusqu’à 3 millions de photos, avec une entreprise spécialisée dans l’IA appelée Clarifai. Cette entreprise n’était rien de tout cela — ni prestataire de services, ni partenaire, ni filiale — et OkCupid n’a jamais demandé le consentement des utilisateurs, ni ne leur a donné la possibilité de refuser. En pratique, cela a laissé des millions de personnes totalement inconscientes du fait que leurs données étaient réutilisées en coulisses.

Comment et pourquoi cela s'est-il produit ? L'explication est assez banale. Les fondateurs d'OkCupid avaient des intérêts directs dans Clarifai, qui a par la suite utilisé ces 3 millions de photos et d'autres données utilisateur pour développer des outils de reconnaissance faciale et de traitement d'images. En effet, ils avaient investi dans cette entreprise et considéraient OkCupid comme une source de données pratique. Comme l'a rapporté Ars Technica, le PDG de Clarifai a reconnu que ces données les avaient aidés à construire un système capable d’« identifier l’âge, le sexe et l’origine ethnique des visages détectés », ce qui signifie que les photos des utilisateurs ont été transformées en matériel d’entraînement pour un outil qu’ils n’avaient jamais accepté de soutenir. La FTC a noté que, pendant des années, OkCupid a tenté de nier toute relation avec cette entreprise d’IA.

Sur le papier, cela aurait pu être présenté comme acceptable au regard de conditions d’utilisation formulées de manière vague. Mais dans la pratique, OkCupid traitait les données des utilisateurs comme si elles lui appartenaient tout simplement. Cela va à l’encontre de l’esprit des engagements pris en matière de confidentialité. En effet, ce que la politique suggérait et ce que les utilisateurs croyaient raisonnablement, c’était que leurs données ne seraient utilisées que de la manière explicitement décrite. Et l’entraînement de modèles d’IA n’en faisait en aucun cas partie.

Pour comprendre à quel point ce comportement est problématique, imaginez un simple scénario : imaginez que les fondateurs n’aient pas investi dans une entreprise d’IA, mais dans une société de courtage en assurance automobile ou une compagnie d’assurance maladie, puis qu’ils aient simplement donné à cette entreprise, sans aucun lien avec OkCupid, l’accès aux données sensibles des utilisateurs collectées par OkCupid. Ces données auraient alors pu être utilisées, par exemple, pour déduire le mode de vie, l'orientation sexuelle ou les risques de santé des personnes, puis influencer leurs tarifs d'assurance ou leur éligibilité — en d'autres termes, entraîner des conséquences négatives dans la vie réelle pour les utilisateurs sur la base de données qu'ils n'avaient jamais sciemment partagées à cette fin.

Une punition trop légère

On pourrait penser qu’une telle gestion négligente des données des utilisateurs entraînerait des sanctions sévères. Mais cela n’a pas été le cas. Dans le cadre de l’accord, OkCupid s’est essentiellement vu interdire de présenter de manière trompeuse ses pratiques de collecte de données et ses mesures de protection de la vie privée à l’avenir. Pas d'amendes salées — en fait, pas d'amendes du tout — et aucune conséquence réelle à long terme au-delà de l'obligation de se conformer. En théorie, les personnes concernées pourraient encore tenter d'intenter une action devant un tribunal civil, mais cela a peu de chances d'aboutir, d'autant plus que Match n'a reconnu aucune faute.

Ce type de sanction est difficile à prendre au sérieux. En effet, il ne s'agit pas d'une sanction, mais d'une simple réaffirmation des règles. En substance, cela revient à leur dire de ne pas faire quelque chose qu’ils n’étaient pas censés faire au départ. Cela donne l’impression qu’il s’agit moins d’une mesure coercitive que d’une simple promesse d’honneur. Et c’est difficile à faire croire, venant d’une entreprise qui a déjà montré qu’elle était prête à contourner, voire à ignorer ses propres promesses lorsque cela l’arrangeait.

Le partage des données des utilisateurs sans leur consentement : la règle, et non l'exception

Le cas d'OkCupid n'est que l'exemple le plus récent de ce type d'attitude possessive envers les données des utilisateurs. Mais alors que certains affirment — notamment Match Group — que les temps ont changé et que ces pratiques laxistes appartiennent depuis longtemps au passé, rien n'est plus éloigné de la vérité. Les cas d'entreprises traitant de manière abusive les données des utilisateurs, souvent en les partageant discrètement ou en les vendant carrément sans consentement clair, se sont multipliés ces dernières années.

Prenons l'exemple de Grindr. Ces dernières années, l'application a été frappée de lourdes sanctions à travers l'Europe après qu'il a été découvert qu'elle partageait des données hautement sensibles, notamment l'orientation sexuelle, la localisation précise et les identifiants publicitaires, avec des centaines de partenaires publicitaires sans consentement valable, [ce qui a entraîné une amende de 6,1 millions de dollars en Norvège](https://www.datatilsynet. no/en/regulations-and-tools/regulations/avgjorelser-fra-datatilsynet/2021/ gebyr-til-grindr/) et une action collective en cours au Royaume-Uni concernant le partage présumé de données liées au VIH avec des agences de publicité.

Ou encore une autre application de rencontre, Raw, où, en 2025, une faille de sécurité a révélé la localisation exacte des utilisateurs, au niveau de la rue, ainsi que des informations personnelles telles que leurs préférences sexuelles et leurs dates de naissance. Ce type de divulgation ne crée pas seulement des risques en ligne — il peut se traduire par une vulnérabilité dans le monde réel. Ajoutant une touche plus dystopique, l'incident s'est produit à un moment où l'entreprise envisageait de créer un appareil portable destiné à surveiller les signaux physiologiques des partenaires, soulevant des inquiétudes évidentes quant à la surveillance venant s'ajouter à des pratiques déjà douteuses en matière de données.

Et cela ne concerne pas uniquement les applications de rencontre. En 2024–2025, il a été découvert que General Motors et sa division OnStar avaient discrètement collecté des données détaillées sur le comportement au volant. Ces données comprenaient des informations sur le freinage, la vitesse et la localisation, qui ont ensuite été vendues à des courtiers en données, puis utilisées par les assureurs pour augmenter les primes, parfois de manière spectaculaire. Là encore, cela a eu des conséquences financières concrètes pour les utilisateurs. La FTC a finalement interdit cette pratique pendant cinq ans à la suite d'une enquête.

Des schémas similaires sont également apparus ailleurs — des plateformes de réseautage comme LinkedIn aux [courtiers en données](GHOST_URL/en/blog/ location-sale-ban-broker-ftc.htm) et même aux logiciels de sécurité. Dans tous ces cas — et d'autres restent à découvrir —, les données des utilisateurs ont été discrètement réutilisées, partagées ou vendues sans que les personnes concernées n'en aient jamais vraiment eu connaissance. Cela montre surtout que l'idée selon laquelle les promesses en matière de confidentialité ne sont guère plus que du vent n'a pas vraiment disparu.

Les conséquences réelles pour les utilisateurs

Il est facile de considérer ces cas comme de simples violations abstraites ou des problèmes réglementaires, mais les conséquences sont tout sauf abstraites. Lorsque ce type de données est partagé, divulgué ou réutilisé à d’autres fins, il peut révéler des informations profondément personnelles : de l’orientation sexuelle à l’état de santé, en passant par l’historique précis des déplacements, et souvent ces informations sont utilisées par des tiers dont les utilisateurs ignoraient même l’existence.

Cela peut entraîner toutes sortes de conséquences, allant de la manipulation ciblée et du profilage à des risques concrets, tels que le harcèlement, la discrimination ou des sanctions financières, comme on le voit avec les données d'assurance. Et une fois que ces données sont divulguées, il n'y a aucun moyen réel de les récupérer ou de contrôler leur utilisation ultérieure. Et à mesure que de plus en plus de systèmes s'appuient sur la collecte de ce type de données, les enjeux ne font que s'accroître.

Cela devient particulièrement évident avec les nouvelles pratiques telles que la vérification de l'âge, qui se généralise à travers le monde et exige souvent des utilisateurs qu'ils fournissent des informations hautement sensibles, telles que des scans faciaux ou des pièces d'identité officielles.

Plus les enjeux sont importants, plus le problème est grave

Ainsi, même si les risques et les inquiétudes ne sont pas nouveaux, la situation devient de plus en plus précaire. Prenons l'exemple d'entreprises comme [Yoti, leader britannique de la vérification d'âge, qui s'est récemment avéré collecter et conserver des données biométriques sans consentement valable](https://adguard-vpn.com/fr/blog/ yoti-age-verification-gdpr-violation.html) — ou Discord, qui a mis en place une vérification d'âge basée sur une pièce d'identité avant de se retrouver dans une situation délicate après que ces données ont été exposées lors d'une violation. Dans les deux cas, les utilisateurs ont été invités à fournir des données hautement sensibles, qui ont ensuite été mal gérées ou exposées.

Le monde dans son ensemble s'oriente vers une collecte accrue de données au nom de la commodité. Nous sommes de plus en plus entourés de technologies reposant sur le même principe — des systèmes de surveillance domestique comme Ring aux réseaux de suivi à l'échelle de la ville comme Flock, qui utilisent des caméras alimentées par l'IA pour enregistrer les plaques d'immatriculation et les détails des véhicules dans des bases de données consultables

Mais même si ces innovations sont présentées comme un atout pour la sécurité, elles s'inscrivent toutes dans le même problème sous-jacent. On attend de vous que vous ayez confiance dans le fait que ces systèmes ne seront pas piratés, et en même temps que vous ayez confiance dans le fait que les entreprises n'utiliseront pas vos données à mauvais escient. Mais nous avons déjà vu ces deux cas de figure se produire, souvent à l'insu des utilisateurs. Même lorsque les politiques semblent rassurantes, il y a toujours des personnes au sein des organisations qui y ont accès, et il suffit d'un seul abus ou d'une seule pomme pourrie.

C’est pourquoi des pratiques telles que la collecte massive de données, le suivi comportemental ou la surveillance permanente — qu’elles soient présentées sous le couvert de la sécurité, de la personnalisation ou de l’innovation — apparaissent de moins en moins comme des atouts et de plus en plus comme des risques. Car si quelque chose tourne mal, ce sont les utilisateurs qui en subissent les conséquences, et non les entreprises qui collectent les données. On attend de nous que nous fassions confiance aux entreprises pour qu’elles agissent correctement, et que nous comptions sur quelqu’un pour intervenir lorsqu’elles ne le font pas (si tout tombe bien pour nous). Peut-être cela a-t-il toujours été le cas. Mais tant qu’il n’y a pas de véritables conséquences — comme l’a montré l’affaire OkCupid —, elles n’ont guère de raison de changer leur façon de faire la prochaine fois.