TechTok #13. As IAs usam seus dados para treinamento?

A IA hoje parece ter encontrado seu caminho em praticamente todos os aspectos da vida, com aplicações que vão desde áreas óbvias, como programação ou processamento de imagens, até outras menos evidentes, como diagnóstico de doenças e trabalho jurídico. A IA está absolutamente em todo lugar. E, mesmo que você saiba muito pouco sobre como ela funciona, provavelmente já ouviu dizer que toda IA precisa de grandes volumes de dados para aprender antes de poder ser utilizada.

Esses dados precisam vir de algum lugar — e isso nos leva à primeira pergunta do TechTok de hoje:

Apps e sites estão usando meus dados para treinar IA sem que eu saiba?

Não existe uma resposta curta e definitiva para essa pergunta. O mais próximo disso seria: “Sim, usam, mas não necessariamente da forma como você imagina”. Sabemos que você provavelmente não veio aqui em busca de uma resposta tão ampla. Mas, antes de nos aprofundarmos, vamos esclarecer uma coisa: “treinar IA” e “coletar dados” não são sinônimos, embora estejam relacionados. Simplificando, para treinar IA você precisa de dados — então encontrar maneiras de obter esses dados é um dos maiores desafios ao construir um sistema de IA. No entanto, existem inúmeras outras razões pelas quais alguém pode querer acessar suas informações.

A questão é que o conceito de coleta de dados online existe há décadas, muito antes de a IA sequer aparecer no horizonte digital, e a principal força por trás da coleta de dados de usuários por muitos anos foi a publicidade. Sistemas extremamente complexos foram criados para montar perfis de usuários e rastreá-los em diversos apps e sites, tudo com o objetivo de saber exatamente qual anúncio mostrar para qual pessoa e em que momento — aumentando a probabilidade de ela clicar no banner. O mercado de publicidade digital é estimado em cerca de 600 a 700 bilhões de dólares por ano, e na base desse mercado estão os dados dos usuários — o que dá uma boa ideia de por que os dados são frequentemente chamados de “o novo petróleo”.

Claro, existem outros motivos pelos quais empresas buscam dados digitais: personalização, recomendações, detecção de fraudes, faturamento, retenção e análise de produto — muitas vezes essenciais em setores como finanças, varejo, telecomunicações e marketplaces. Os motivos exatos não são o ponto aqui. O que queremos destacar é que a coleta massiva e global de dados não surgiu com a IA. Na verdade, em muitos casos, os métodos usados hoje para coletar dados para treinamento de IA são os mesmos que já eram usados há anos para outros fins, então as empresas de IA não precisaram reinventar a roda — ou pelo menos já tinham uma base muito sólida para começar.

Os tipos de dados necessários para rastreamento de anúncios e para treinamento de IA também se sobrepõem bastante — o que pode surpreender algumas pessoas. Para muitos, os termos “IA” e “LLM” (modelo de linguagem grande) são sinônimos. De fato, chatbots (que basicamente são interfaces voltadas ao usuário com um LLM por trás) são talvez o tipo de IA com o qual o usuário comum mais interage. É lógico pensar que treinar uma IA generativa usada em chatbots exige conjuntos de dados com grandes quantidades de texto gerado por usuários — como posts e comentários em plataformas como Reddit ou X, mensagens, avaliações etc. Isso está correto, já que esses modelos precisam aprender como as pessoas realmente falam, como responder perguntas, como funcionam conversas reais — incluindo humor, gírias e tom. Mas o que muita gente não percebe é a quantidade de outros tipos de IA além da generativa, criados para diferentes finalidades — sistemas de recomendação, ranking de busca, segmentação de anúncios, só para citar alguns. Para esses sistemas, os dados comportamentais são essenciais, enquanto o conteúdo em si é menos importante. E muitas plataformas modernas combinam as duas abordagens: precisam tanto do conteúdo bruto quanto de saber no que você clica e quando.

Voltando à pergunta inicial: sim, algumas empresas de IA usam seus dados para treinar seus sistemas, mas, em grande parte, fazem isso da mesma forma que elas (e outras empresas) já coletavam seus dados antes da IA, para outros fins. E aqui entra a parte complicada — tecnicamente, a maioria das empresas não coleta dados “pelas suas costas”, seja para treinar IA ou para qualquer outro propósito — fazer isso é ilegal em muitas jurisdições. Algumas chegam a fazer anúncios públicos sobre o uso de dados para treinar IA, embora algumas suavizem isso mais do que outras. Ao mesmo tempo, é bastante comum esconder a coleta contínua de dados em políticas de privacidade extensas, termos de uso cansativos e outros documentos legais longos e pouco atraentes. Quem tem um humor mais ácido pode até achar curioso que políticas de privacidade que tratam do uso de dados para treinar IA frequentemente utilizem a mesma linguagem vaga e ampla encontrada em documentos sobre coleta de dados para publicidade.

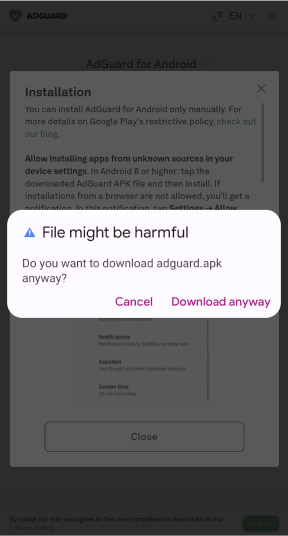

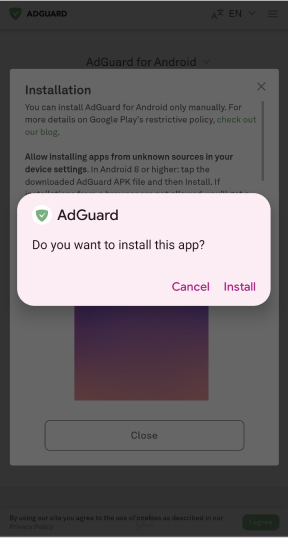

Mas, mesmo que você faça sua parte e encare todo o juridiquês para garantir que o app que pretende instalar não use seus dados para alimentar a proverbial máquina, a triste realidade é que você ainda não está totalmente seguro. Às vezes, os desenvolvedores “esquecem” de mencionar isso — como no caso recente em que o OkCupid, um popular app de namoro, compartilhou 3 milhões de fotos de usuários com uma empresa de IA para treinamento — tudo isso sem avisar seus usuários. Isso não é novidade; as mesmas práticas questionáveis existem há muito tempo, mesmo antes da IA. Infelizmente, onde há lucro a ser obtido, sempre haverá quem feche os olhos para a lei em benefício próprio.

Como seus dados acabam sendo usados para treinar IA?

Vamos dar um passo atrás. Já tocamos brevemente no tema de quais dados são usados para treinar IA e mencionamos que vale praticamente tudo: tanto conteúdo bruto, como textos e fotos, quanto dados comportamentais, como cliques e outras interações. Mas muitos leitores provavelmente querem algo mais específico e se perguntam: “O que exatamente dos meus dados pode acabar sendo usado para IA — e como?” Bem, nem todos os dados são usados da mesma forma. Alguns podem ser mais sensíveis, e dados de diferentes fontes podem alimentar a IA de maneiras distintas. Se o objetivo é treinar IA, existem inúmeras fontes possíveis de dados. Para os fins deste artigo, vamos dividir em quatro categorias, dependendo de como os dados são coletados:

- Redes sociais (dados disponíveis publicamente)

- Conversas com chatbots (entrada direta)

- Interações em plataformas (dados comportamentais)

- Apps e sites de terceiros

Para começar, se você publica ou comenta algo publicamente — no Reddit, YouTube, X, Facebook etc. — isso não significa automaticamente que qualquer pessoa pode usar esse conteúdo para treinar IA, mas você também geralmente não tem meios reais de impedir que a plataforma use seus dados para esse fim ou os compartilhe com terceiros. Claro, tudo varia bastante de plataforma para plataforma, mas a regra geral é: se é público, provavelmente você não tem controle total sobre isso. Plataformas que não usam os dados diretamente muitas vezes os vendem ou compartilham de alguma forma. Usuários da UE costumam estar mais protegidos, graças à legislação avançada de privacidade. Regulamentos como o GDPR e o AI Act da UE garantem direitos como ser informado, se opor a certos tratamentos, solicitar acesso ou exclusão de dados em alguns casos e restringir o uso de dados pessoais para treinamento de IA.

Mas e quando você conversa diretamente com um chatbot? Qual a chance de seus dados serem usados para treinar IA? Depende do serviço, claro, mas na maioria das ferramentas de IA voltadas ao consumidor, tudo o que você digita ou envia pode ser usado para melhorar o serviço. Mesmo em planos pagos, a menos que sejam corporativos (não individuais), seus dados ainda costumam ser considerados utilizáveis. Vale mencionar que muitos chatbots oferecem opção de opt-out, embora frequentemente ela fique escondida nas configurações. Para muitos leitores, essa é uma das principais dúvidas: “Como desativar a coleta de dados ao usar um chatbot?” Em vez de ficar só na teoria, aqui vão alguns exemplos práticos com ferramentas populares (considerando uso pessoal):

ChatGPT. Abra o ChatGPT, vá até seu perfil, depois Configurações → Controles de dados, e desative “Melhorar o modelo para todos”. A OpenAI afirma que isso impede o uso das suas conversas para treinamento futuro, embora alguns dados ainda possam ser retidos.

Perplexity. Acesse Configurações da conta → Preferências e desative “AI data retention”. Isso afeta apenas dados futuros — dados coletados antes disso ainda podem ser usados.

Gemini. Na sua conta Google, vá em Dados e privacidade e encontre “Atividade dos apps Gemini”. Selecione “Desativar” ou “Desativar e excluir atividade”. Isso não afeta interações passadas.

Claude.O Claude não treina seus modelos com suas conversas por padrão, oferecendo apenas a opção de participar voluntariamente. Se você apagar uma conversa, a Anthropic a remove em cerca de 30 dias.

Quanto à coleta de dados comportamentais, uma forma simples (e geralmente correta) de entender é: quanto maior a plataforma, mais ela depende desses dados; apps menores e mais específicos raramente fazem rastreamento extensivo. Plataformas grandes como YouTube, TikTok, Netflix, motores de busca e e-commerces como Amazon ou eBay coletam o máximo possível de dados sobre suas atividades para melhorar recomendações e rankings. Isso não significa que apps menores não coletem nada, mas esse tipo de rastreamento costuma ser menos relevante para eles.

E os apps e sites menores do dia a dia? Nem tudo é chatbot ou gigante da internet — e se você instalar um app qualquer ou visitar um site pequeno? Não dá para generalizar, já que existem milhões deles. Mas, em geral, esses apps não coletam dados para treinar suas próprias IAs nem vendem diretamente seus dados. No entanto, é extremamente comum que incluam ferramentas de analytics, redes de anúncios e outros mecanismos de rastreamento para monetização. Esses sistemas coletam dados comportamentais, informações do dispositivo, padrões de uso etc. E quando esses dados chegam a redes de anúncios, brokers de dados e empresas de analytics, eles são agregados e podem ser usados para modelagem, vendidos ou até contribuir indiretamente para treinamento de IA.

Ao ver todas essas formas pelas quais seus dados podem acabar em um dataset de IA, você pode pensar: “Isso é muita coisa para se preocupar!”. E é mesmo — mas lembre-se de que nem todo dado que você fornece é usado, e nem todas as empresas agem da mesma forma. Além disso, existem maneiras de reduzir a quantidade de dados coletados. O que nos leva à segunda pergunta do TechTok de hoje:

Usar um bloqueador de anúncios e/ou uma VPN pode impedir o rastreamento e a coleta de dados para IA?

Como vimos, o rastreamento ligado à IA acontece de muitas formas diferentes, então não dá para responder com um simples “sim” ou “não”. Tanto bloqueadores de anúncios quanto VPNs ajudam — cada um à sua maneira — mas não resolvem tudo.

Primeiro: nenhum dos dois ajuda se você fornece dados ativamente — como conversar com um chatbot, postar em redes sociais ou comentar. Eles não podem impedir que uma plataforma use algo que você já forneceu. Nesse caso, o melhor caminho são configurações de privacidade, opções de opt-out e leis de proteção de dados. Vale a pena revisar as políticas de privacidade e configurações dos serviços que você usa — e, se não gostar, considerar alternativas.

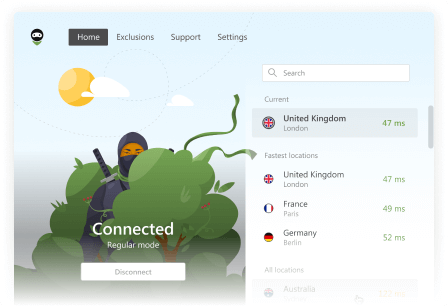

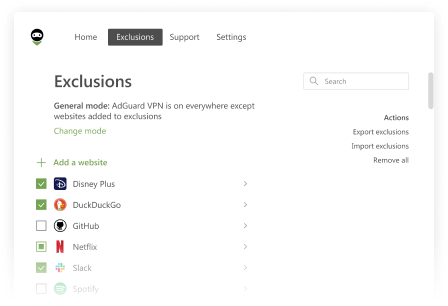

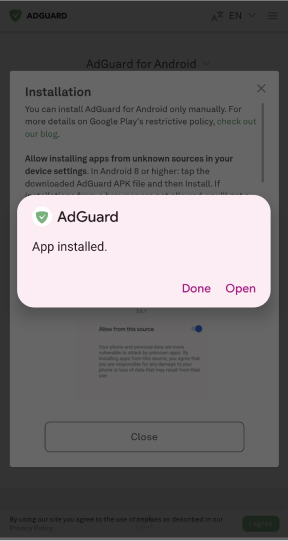

O que bloqueadores de anúncios fazem bem é barrar rastreadores de terceiros e, em certa medida, reduzir o rastreamento comportamental. Bloquear analytics de terceiros é, sem dúvida, o ponto forte deles quando se trata de evitar vazamento de dados. Ferramentas como o AdGuard conseguem lidar com a maioria desses rastreadores em sites. Em apps, é mais complicado — especialmente por limitações do Android e iOS.

Bloqueadores também ajudam a reduzir coleta de dados comportamentais, mas não totalmente. Muitas plataformas usam rastreamento próprio (first-party) e não dependem de terceiros. Bloquear esse tipo de rastreamento pode até quebrar funcionalidades — por exemplo, impedir que vídeos carreguem no YouTube. E, novamente, isso é ainda mais complexo em apps móveis.

Ainda assim, bloqueadores são uma das melhores ferramentas disponíveis se o objetivo é reduzir o fluxo de dados para treinamento de IA. E as VPNs?

VPNs são ótimas — alguns diriam essenciais — para privacidade. Mas, especificamente para impedir o uso de dados no treinamento de IA, sua eficácia é limitada. Elas ajudam de forma indireta: escondem seu IP e mascaram sua localização, dificultando a criação de perfis baseados na sua identidade de rede. Porém, não impedem que as plataformas vejam o que você faz nelas. Se você está logado ou interagindo com um serviço, seus cliques e entradas ainda são registrados. E VPNs também não bloqueiam rastreadores de terceiros — isso continua sendo função dos bloqueadores (embora a VPN possa reduzir a precisão do rastreamento).

Resumo: bloqueadores de anúncios e VPNs são ferramentas valiosas para proteger sua privacidade — especialmente os bloqueadores. Mas, no fim das contas, a segurança dos seus dados depende principalmente da sua atenção e das suas escolhas. Ler políticas de privacidade, usar configurações adequadas e ter cuidado com o que você compartilha online pode reduzir bastante as chances de seus dados irem parar no treinamento de alguma IA futura. Ferramentas ajudam — mas nada substitui o bom e velho cuidado.