Sprachassistenten kennen unsere Geheimnisse. Müssen wir uns Sorgen machen?

Tech-Giganten wie Google oder Amazon, Apple oder Microsoft sammeln eine große Menge an Daten über uns geben diese weiter — wir alle wissen das. Aber wir wären nicht bereit, ihre Produkte aufzugeben: die sind allzu komfortabel. Sprachassistenten gehören auch dazu.

Bitten Sie Siri, Ihnen einen Witz oder eine Gutenachtgeschichte zu erzählen, und Sie fühlen sich nicht mehr einsam oder gelangweilt. Wenn Sie sich nicht entscheiden können, bitten Sie sie, eine Münze zu werfen. Oder fügen Sie etwas Magie hinzu und verwenden Sie Harry Potter-Zaubersprüche anstelle von Befehlen. Und für manche Menschen machen Sprachassistenten das Leben wesentlich einfacher: zum Beispiel für Menschen mit Sehproblemen.

Sprachassistenten leisten tatsächlich einen guten Beitrag zu unserem Komfort. Beim Autofahren können Sie Telefonanrufe, Nachrichten, Navigation, News, Buchungen usw. freihändig verwalten — fantastisches Multitasking. In Smart Homes können Sie Ihren Assistenten bitten, die Tür zu öffnen oder das Licht einzuschalten. Sie können Texte durch Diktieren besser verfassen. Und Sie können sich mit Fremden unterhalten, ohne deren Sprache zu kennen.

Aber dieser praktische Nutzen hat auch eine Kehrseite, und Sprachassistenten sind ein ziemlich heikles Thema. Entweder sind Sie von ihnen begeistert — oder fürchten Sie sie und versuchen, sie um jeden Preis zu vermeiden. Und dafür gibt es Gründe. Der Fokus der großen Technologiekonzerne liegt nicht primär auf Sprachassistenten — deshalb werden Fragen des Datenschutzes oft übersehen.

Problem #1: Die Daten werden in der Cloud verarbeitet

Es gibt verschiedene Funktionsweisen von Sprachassistenten.

Einige von ihnen nehmen Audiodaten auf, komprimieren sie und schicken sie dann an die Server des Unternehmens, wo sie verarbeitet werden. Das Ergebnis — die „Antwort” — wird an Ihr Telefon oder ein anderes Gerät mit Sprachassistententechnologie zurückgesendet, das ein lokales Sprachsynthesesystem verwendet, um den Eindruck eines kohärenten Dialogs zu erwecken.

In diesem Fall sind es Sprachdaten, die in der Cloud gespeichert werden — und das war bis vor kurzem die einzige Option: Früher hätte die genaue Interpretation von Sprachbefehlen weit mehr Rechenleistung erfordert, als ein einzelnes Gerät aufnehmen konnte. Und durch die Verwendung der Cloud-Sprachverarbeitung konnte man mit weniger Ressourcen mehr erreichen.

Doch Ende 2021, nach mehreren Skandalen mit Datenlecks und entscheidenden Fehlern, haben die meisten großen Technologieunternehmen — wie Google, Amazon, Microsoft, Apple oder Samsung — ihre Datenschutzrichtlinien sowie die von ihnen verwendeten Technologien aktualisiert. Jetzt verwenden die meisten von ihnen, zumindest teilweise, Sprachverarbeitung auf dem Gerät. Dies könnte einige der Befürchtungen in Bezug auf die Privatsphäre zerstreut haben: Wenn Ihre Stimme Ihr Gerät nicht verlässt, wird niemand wissen, wie sie klingt, und sie zu seinem Vorteil nutzen. Tatsächlich hat sich die Situation dadurch aber kaum verändert.

Die Daten werden immer noch erfasst — aber im Textformat. Nachdem die Geräte die Sprachdaten lokal verarbeitet haben, senden sie die Transkripte an die Server, um zu „verstehen”, was Sie gesagt haben, und um zu antworten.

Und nur für wenige Befehle — wie z. B. „Wecker auf 7 Uhr stellen” oder „Mama anrufen” — ist keine Internetverbindung erforderlich. Die Transkripte werden nirgendwohin gesendet, alles wird lokal auf Ihrem Gerät erledigt.

Okay, wo liegt denn das Problem?

Das Problem ist die Cloud selbst. Die Daten sind in Sicherheit (zumindest in mehr Sicherheit), solange sie lokal gespeichert sind: Niemand außer Ihnen hat Zugang dazu, während in der Cloud viel mehr Menschen darauf zugreifen können.

In dem seltenen Fall, wenn jemand Ihr Gerät angreift, wird er Zugang lediglich zu Ihren Daten haben. Wenn die Daten jedoch in der Cloud gespeichert sind, können die Informationen von Millionen von Nutzer:innen durch ein Leck oder einen Angriff offengelegt werden.

Fehler können entscheidend sein

Wenn Sie die Funktion „Auf Weckwort reagieren” nicht deaktiviert haben, hören die Sprachassistenten ständig zu. Sie brauchen dieses Weckwort, um mit der Interaktion zu beginnen, und bis dahin befinden sie sich also immer in einer Art „Wartemodus”. Hey, Siri! Oder war es einen „City”? Oder nur ein Reißverschluss-Geräusch?. Es gibt unzählige Fälle, in denen Sprachassistenten zufällige Phrasen fälschlicherweise als Weckwörter interpretiert haben: in einer Fernsehsendung, die im Hintergrund läuft, in einem freundlichen Gespräch, in einer Erklärung eines britischen Abgeordneten im Unterhaus... Alles, was nach dem Weckwort gesagt wird, gilt als Befehl. Auch wenn Sie nicht sprechen wollten, wird Ihr Sprachassistent zuhören.

Problem #2: Unternehmen lassen Mitarbeiter:innen Ihre Gespräche mithören

Wenn Sie Ihrem Sprachassistenten erlauben, zuzuhören, kann nicht nur er mithören. Um zu analysieren, wie genau Sprachassistenten reagieren, arbeiten Unternehmen mit Sprachexperten zusammen, die sich einige der Aufnahmen Ihrer Gespräche mit den Assistenten anhören.

Ja, sie tun dies nur mit Ihrer Zustimmung. Ja, sie wählen nur einen kleinen Prozentsatz der aufgezeichneten Daten aus. Ja, die Informationen werden anonymisiert. Aber erstens, wenn Sie sich erinnern, können Fehler passieren. Wir haben bereits früher über Apple geschrieben, das Ihre Audiodaten auch dann aufzeichnete, wenn Sie dies abgelehnt hatten. Außerdem wurde berichtet, dass etwa 1.000 Wortfolgen von verschiedenen Sprachassistenten fälschlicherweise als Triggerwörter interpretiert werden können. Die Aufnahmen, die abgehört werden, können alle erdenklichen Informationen enthalten: Familienstreitigkeiten, Gespräche zwischen Ärzt:innen und Patienten, Geschäftsabschlüsse, Drogengeschäfte, Sex-Geräusche und so weiter.

Zweitens sind die Daten nur in dem gesetzlich vorgeschriebenen Mindestmaß anonymisiert. Diese Aufnahmen werden begleitet von Nutzerdaten mit Standort, Kontaktangaben und App-Daten.

Abgesehen davon, dass es bereits ausreicht, um einen Nutzer / eine Nutzerin angreifbar zu machen, könnte das Mithören privater Gespräche durch Fremde beispielsweise gegen medizinische Konventionen verstoßen, indem die Schweigepflicht gebrochen wird. Stellen Sie sich vor: Sie sind ein Arzt / eine Ärztin. Sie haben sich gegen die Aufzeichnung Ihrer Sprachdaten entschieden. Aber es gab einen Fehler im System, und das Gespräch mit Ihrem Patienten wurde trotzdem aufgezeichnet. Und war unter den Aufnahmen, die von menschlichen Mitarbeiter:innen untersucht wurden. Oder vielleicht haben Sie ja gesagt, weil Sie erwartet hatten, dass Ihr Sprachassistent nur Ihre Interaktionen mit ihm aufzeichnet, mehr nicht — aber der Assistent hat ein Wort falsch verstanden und mit der Aufzeichnung begonnen. Wer hat hier die Vertraulichkeit verletzt und wie hätten Sie das verhindern können? Bei all diesen Fehlern scheint es, als könnten Sie nicht mit Sicherheit sagen, ob die Informationen, die Sie in einem Gespräch teilen, sicher sind — nur weil Sie einen Sprachassistenten auf Ihrem Telefon installiert haben.

Problem #3: Sprachassistenten können mehr erfahren — und nicht nur sie

Selbst wenn Ihre Aufnahmen nicht zu diesem kleinen Teil der analysierten Daten gehören, befinden sie sich immer noch auf den Servern. Apple speichert Abschriften von dem, was Sie diktieren, sofern nicht anders angegeben. Microsoft erlaubt sich den Zugriff auf Ihre Sprachtranskripte ohne Ihre Zustimmung. Amazon speichert eine große Menge an Audioinformationen: Vor nicht allzu langer Zeit hat eine Twitter-Nutzerin ein Bild gepostet, das zeigt, wie viele Daten Alexa über sie hat. Ein Reuters-Reporter fand heraus, dass innerhalb von vier Jahren Amazons Alexa mehr als 90.000 Aufnahmen von ihm und seinen Familienmitgliedern gemacht hatte. (Übrigens, wenn Sie wissen möchten, wie Sie diese Informationen anfordern können, hier ist eine Anleitung von Amazon).

Und während zufällige Geräusche keinen großen kommerziellen Wert haben, haben Aufnahmen Ihrer echten Gespräche mit Sprachassistenten einen. Alle Unternehmen sind begierig darauf zu erfahren, welche Interessen Sie haben — nur manche sind begieriger als andere. Was Sie suchen, was Sie kaufen, welche Kanäle Sie sehen, mit wem Sie Ihre Zeit verbringen und so weiter — all das sind Daten, die sich zu Geld machen lassen.

Abgesehen davon sind auch andere Parteien an Ihrer Persönlichkeit interessiert: Hacker und das FBI (und einige als Polizisten getarnte Hacker könnten sogar von Apple und Meta Nutzerdaten anfordern und stehlen). Persönliche Daten können durchsickern, sie können vom staatlichen Überwachungsapparat angefordert werden, und die von Sprachassistenten gesammelten Daten können äußerst sensibel sein.

Zum Thema Datenlecks: Angeblich könnte Amazon den Überblick über die eigenen Datensammlungen verloren haben: Quellen aus dem Unternehmen zufolge wisse Amazon nicht, wo Nutzerdaten gespeichert würden und könne demnach auch weder gewährleisten, dass Daten tatsächlich gelöscht werden, noch Datenlecks identifizieren.

Problem #4: Nicht alles kann gelöscht werden

Auch könne Amazon nicht sicherstellen, dass die von den Nutzer:innen geforderte Löschung der Daten tatsächlich gelungen sei. Technisch gesehen gibt es die Möglichkeit, die Protokolle Ihrer Interaktion mit Sprachassistenten anzufordern und das Unternehmen zu bitten, sie zu löschen. Dies gilt für die meisten Fälle, einschließlich Alexa, Cortana und Google Assistant. Was Siri betrifft, wird Apple Ihnen die Protokolle nicht zur Verfügung stellen und nur die Daten löschen, die weniger als sechs Monate alt sind — nach diesem Zeitraum verlieren die Audiodaten oder die Transkripte ihre eindeutige Kennung und können zur Verbesserung verwendet werden. Aber werden Ihre Daten wirklich gelöscht?

Wenn Sie den Anbieter um die Protokolle Ihrer Interaktionen mit Sprachassistenten bitten, können Sie — theoretisch — erwarten, dass das Unternehmen die bearbeiteten Anfragen löscht, die an Ihre ID gebunden ist. Allerdings gibt es auf der anderen Seite Ihrer Anfrage — auf der Bearbeitungsseite — ein Informationssystem, das immer noch etwas über Sie hat. Es speichert (zumindest) Protokolle über die Bearbeitung von Anfragen: Anfragen an eine Suchmaschine, an einen Musikdienst, an einen Produktdienst usw.

Außerdem neigen die Unternehmen dazu, Statistiken über die Anfragen der Nutzer:innen zu sammeln. Sie speichern Metriken, um festzustellen, wofür sich die Menschen interessieren — wonach Sie am häufigsten suchen, welche Dienste Sie bevorzugen, welche Musik Sie hören. Erinnern Sie sich an Googles „Year in Search“? Das sind aggregierte Daten, aber sie sind nicht so harmlos. Obwohl die Daten von einer bestimmten Person und ihrer Kennung losgelöst sind, können Anfragen an Sprachassistenten vollständige Namen, Adressen, Berufe usw. enthalten. Die Abschriften werden gelöscht, aber die Tatsache, dass jemand jeden Freitag ein Taxi von einer Bar zu Ihrer Adresse bestellt hat, bleibt bestehen.

Wir können nicht zu 100% sicher sein, dass das Unternehmen alles löscht, wenn wir es darum bitten. Wir können es auch nicht beweisen. Die Moral hier ist dieselbe wie immer: Es ist unsere Entscheidung, ob wir ihnen vertrauen oder nicht.

Sie können die Kontrolle über Ihre Daten übernehmen

Die Unternehmen werden nicht so leicht aufgeben, Informationen über Sie zu sammeln. Je mehr sie wissen, desto mehr Geld verdienen sie mit dem Verkauf dieser Informationen an Werbekunden. Je genauer Ihr Profil ist, desto einfacher ist es, Ihre Aufmerksamkeit zu gewinnen. Machen Sie sich keine Illusionen darüber, dass Unternehmen von jetzt auf gleich aufhören werden, Daten zu sammeln. Das Beste, was Sie tun können, ist es, sich der Risiken bewusst zu sein.

Sie müssen nicht alle Ihre elektronischen Geräte in die Mülltonne werfen. Besser ist es aber, zu wissen, wie Sie diese Risiken abmildern können. Sie können Ihre Daten anfordern, Unternehmen bitten, sie zu löschen, Sprachassistenten in privaten Gesprächen abschalten und Ihre Freunde bitten, dasselbe zu tun.

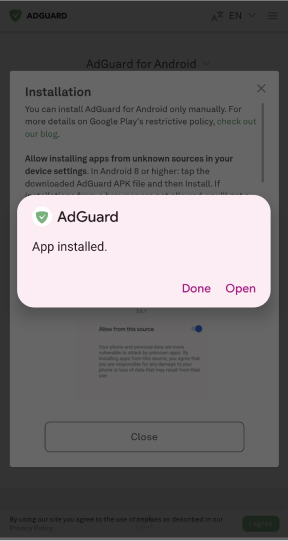

Vielleicht möchten Sie, dass Ihr Gerät Sie warnt, wenn es aktiv zuhört. Vergewissern Sie sich, dass Sie ein sicheres Passwort haben, das nicht auf anderen Geräten wiederverwendet wird, und dass Sie eine Zwei-Faktor-Authentisierung eingerichtet haben. Wenn Sie ein Kind haben, richten Sie eine PIN ein oder deaktivieren Sie den Spracherwerb, es sei denn, Sie möchten, dass Ihr 4-jähriges Kind eine Menge Spielsachen bestellt. Wenn Sie es ganz genau machen wollen, können Sie das Mikrofon Ihres Sprachassistenten stummschalten — in diesem Fall wird er nicht auf ein Weckwort hin aktiviert und muss jedes Mal manuell eingeschaltet werden.

Außerdem können Sie die Datenschutzerklärung der Unternehmen sorgfältig studieren und dasjenige auswählen, das Ihren Bedürfnissen am besten entspricht: vielleicht erklärt jenes Unternehmen ausdrücklich, dass es Ihre Daten nicht an Dritte weitergibt. Oder dass es keine Informationen auf den Servern speichert. Sie können auch Bewertungen und Untersuchungen lesen, um herauszufinden, ob das Unternehmen, dem Sie Ihre persönlichen Daten anvertrauen wollen, bereits mit Datenlecks aufgefallen ist.

In jedem Fall können Sie bei der Verwendung von Sprachassistenten nicht alle Risiken für Ihre Privatsphäre ausschließen. Das Beste, was Sie tun können, ist, die Vor- und Nachteile abzuwägen und selbst zu entscheiden, ob Sie wirklich die Hilfe eines Sprachassistenten benötigen. Eine informierte Entscheidung ist immer die beste Option.