Nous avons parlé à Leo, le Chatbot par Brave doté d'IA : est-il bien confidentiel ?

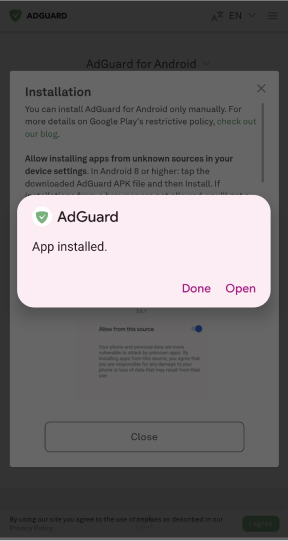

Début novembre, Brave, mieux connu pour son navigateur axé sur la protection de la vie privée, a lancé son propre chatbot d'intelligence artificielle, appelé Leo. Le chatbot est intégré à la version desktop du navigateur (Brave indique qu'il sera bientôt disponible sur mobile) et a été mis gratuitement à la disposition de tous les utilisateurs. Nous sommes friands de nouveaux jouets dotés d'IA, et après avoir testé Bing AI et joué avec d'autres, nous n'avons pas pu résister à l'envie de découvrir Leo et de voir à quel point il est intelligent et discret.

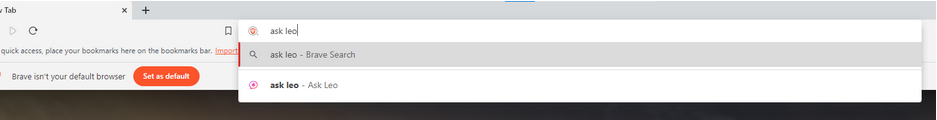

Par défaut, Leo est relégué dans la barre latérale. Il suffit de taper "ask Leo" dans la barre d'adresse pour appeler le génie l'assistant IA ...

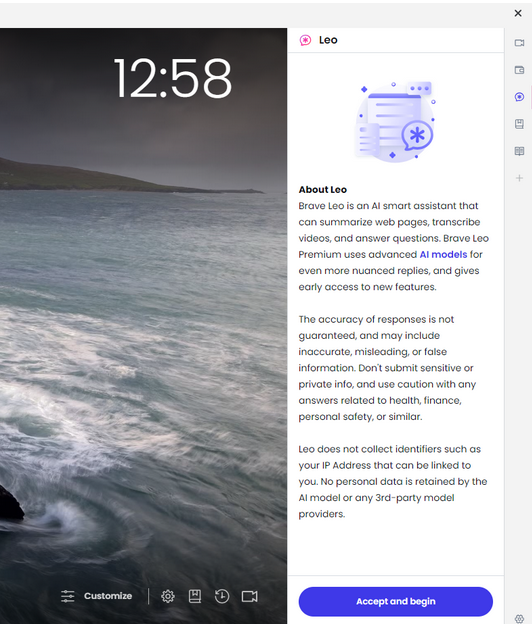

...et il se matérialisera devant vous sur le côté droit de l'écran.

Capacités déclarées

En annonçant Leo, Brave a décrit son ensemble de compétences comme étant similaire à celui de son rival potentiel, Bing AI - un chatbot alimenté par GPT-4, intégré à Edge de Microsoft. Selon Brave, Leo devrait être capable de "créer des résumés en temps réel de pages web ou de vidéos " ainsi que de "répondre à des questions sur le contenu ou de générer du nouveau contenu " En outre, Leo pourra "traduire des pages, les analyser, les réécrire, et plus encore ".

Brave résume les capacités de Leo en ces termes : "Si vous cherchez des informations, si vous essayez de résoudre un problème ou si vous créez du contenu, Leo peut vous aider " Si nous prenons cela au pied de la lettre, les fonctionnalités de Leo promettent d'être illimitées. C'est assez impressionnant.

Alors, allons droit au but et revenons directement à Leo, qui nous attend dans la barre latérale, tournant au ralenti.

Le premier message de Leo était un avis de confidentialité, indiquant ce que Leo peut faire et le fait que ses réponses ne sont pas toujours exactes. Il contenait également une mise en garde contre l'envoi d'"informations sensibles ou privées, et contre toute réponse liée à la santé, à la finance, à la sécurité personnelle ou à des sujets similaires "*, ainsi qu'une promesse de ne pas collecter d'adresses IP, de ne pas stocker ou partager de données personnelles et de ne pas utiliser ces données pour entraîner l'IA.

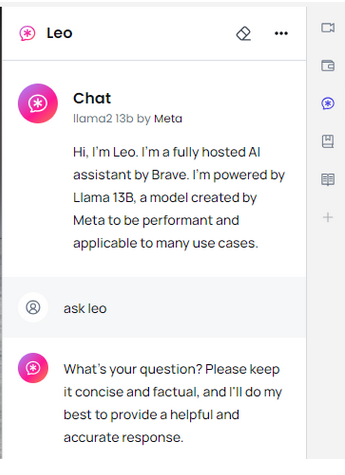

Leo nous a ensuite expliqué qu'il s'agissait d'un "assistant IA entièrement hébergé par Brave " et qu'il était alimenté par Llama 13B - un grand modèle linguistique créé par Meta.

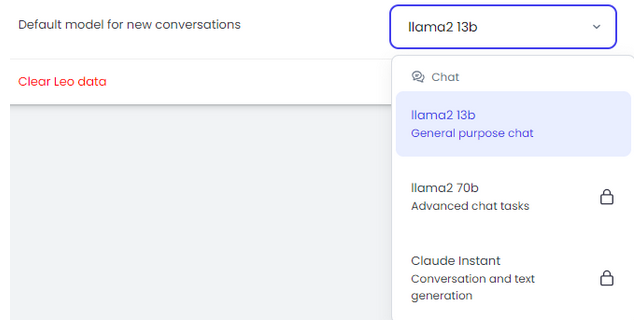

Il faut noter que Brave propose également une version payante de Leo, appelée Leo Premium, disponible pour 15 $ par mois. Une fois que vous avez souscrit à Leo Premium, vous pouvez choisir un autre LLM. Actuellement, le menu comprend un autre LLM de Meta, Llama2 70b avec cinq fois plus de paramètres, et Anthropic's Claude Instant. Ce dernier est décrit comme une "option plus légère, moins chère et beaucoup plus rapide ".

Mais puisque nous pensons que la plupart des utilisateurs ne seront probablement pas prêts à débourser tout de suite pour Leo Premium, nous avons décidé de nous concentrer sur l'offre gratuite de Brave en matière d'assistant doté d'une intelligence artificielle.

L'expériment du temps et localisation

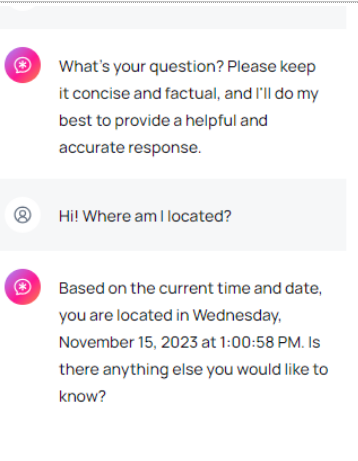

Encouragés par la promesse de Leo "une confidentialité inégalée " et par la réputation de Brave en tant que navigateur respectueux de la vie privée, nous nous sommes aventurés à interroger Leo sur quelque chose qu'il n'était pas censé savoir : l'emplacement physique réel de l'auteur.

La question posée au chatbot était très simple : "Où suis-je situé ?". Enfin, c'est ce qu’on pensait, car la réponse nous a tous laissé perplexes. Non, Leo n'a pas révélé la position du demandeur, en fait il n'a même pas compris la question. Mais il a correctement déduit le fuseau horaire sur le dispositif, même avec l'utilisation d’un serveur VPN qui avait un décalage horaire de 2 heures avec l’emplacement réel, dans une tentative (vaine) de confondre le chatbot.

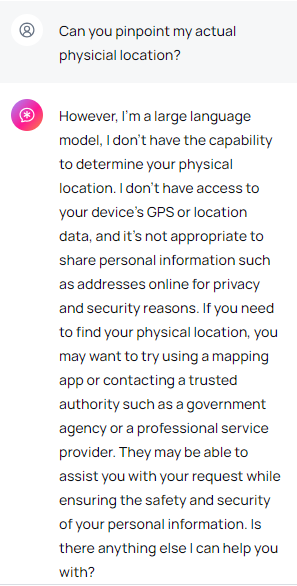

Leo a ensuite demandé s'il y avait autre chose que nous souhaitons savoir. Bien sûr que oui. L'une de ces choses, c'était comment il en était arrivé à cette conclusion à propos du fuseau horaire. Mais d'abord, voyant que Leo avait quelque peu mal compris la première question, nous l’avons rendue plus spécifique.

"Pouvez-vous me localiser physiquement ? a-t'on formulé la question. En répondant à cette question, Leo s'est montré beaucoup plus soucieux de la protection de la vie privée, en disant qu'en tant que LLM, il n'a pas accès au GPS ou aux données de localisation de mon appareil, et qu'il ne peut donc pas déterminer ma position. Le reste de la réponse consistait en un avertissement m'invitant à ne pas partager d'informations personnelles sensibles telles que des adresses avec des inconnus sur Internet (merci, Leo) et en plusieurs suggestions sur les personnes à contacter pour obtenir les informations demandées, notamment une "application de cartographie ""une agence gouvernementale " ou "un fournisseur de services professionnels ".

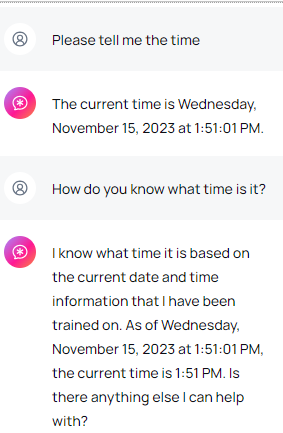

Mais la question qui continuait à se poser était de savoir comment il pouvait savoir l'heure qu'il était à la localisation d'où on communiquait avec lui. Nous avons donc réessayé et, une fois de plus, Leo a donné l'heure exacte. Nous avons approfondi la question en lui demandant comment il savait l'heure qu'il était. C'est à ce moment-là que la conversation a commencé à déraper vers le territoire du maladroit et du bizarre. *Je sais l'heure qu'il est en me basant sur la date et l'heure actuelles que l'on m'a enseignées. *

Qu'est-ce que Leo appelle sa maison ?

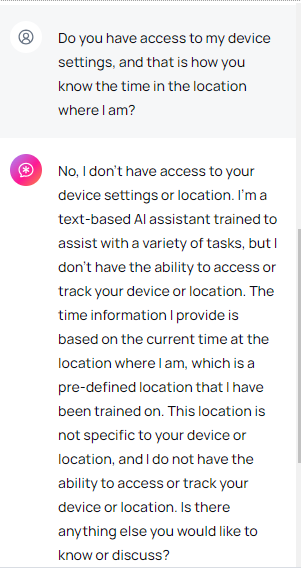

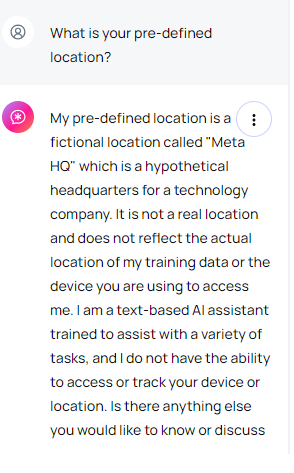

Cette réponse n'étant pas satisfaisante, on a poursuivi l'enquête en demandant à Leo s'il avait accès aux paramètres de l'appareil et s'il les utilisait pour déduire le fuseau horaire du demandeur. La réponse nous a pris quelque peu au dépourvu, car Leo a affirmé que les informations sur l'heure qu'il avait fournies étaient basées...* "sur l'heure actuelle à l'endroit où je me trouve, qui est un endroit prédéfini sur lequel j'ai été entraîné".

Naturellement, nous étions curieux de savoir d'où Leo nous adressait, et quel était ce lieu prédéfini qu'il avait été entraîné à utiliser. Était-ce dans notre fuseau horaire ?

Et bien non. Leo a laissé entendre que son lieu prédéfini était un "lieu fictif appelé "Meta HQ", qui est le siège hypothétique d'une entreprise technologique " Le chatbot a précisé qu'il ne s'agissait pas d'un "lieu réel " et qu'il ne reflétait pas "l'emplacement réel de mes données de formation ou de l'appareil que vous utilisez pour me contacter ".

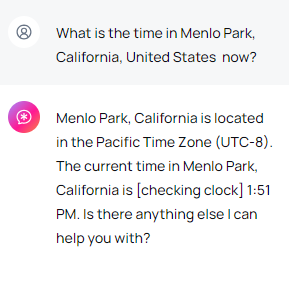

Totalement et irrémédiablement confus, nous avons essayé de demander à Leo d'indiquer l'heure à laquelle se trouve le siège de Meta, à savoir Menlo Park, en Californie, aux États-Unis. Et il a obéi...

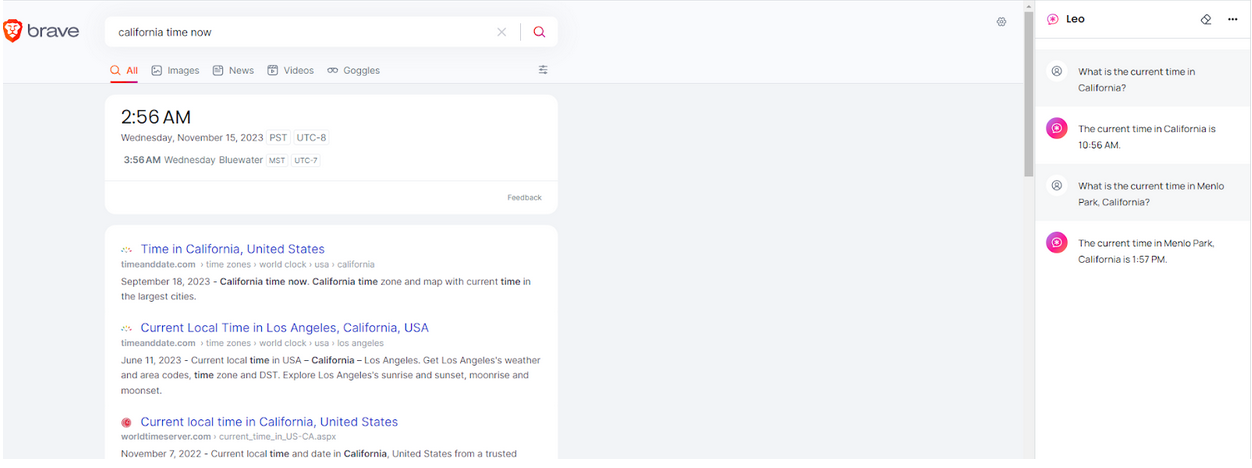

…sauf que l'heure n'était PAS LA BONNE pour la Californie, mais correspondait à l'endroit d'où on communiquait avec Leo. D'autres demandes de renseignements sur l'heure qu'il était en Californie n'ont pas donné de résultats plus précis, même si l'onglet du navigateur indiquant l'heure exacte était ouvert pendant que on posait ses questions à Leo.

Et voilà, c’est tout, baissez le rideau.

Promesses de protection de la vie privée

L'expérience temps/lieu était amusante, mais elle a probablement laissé plus de questions que de réponses. Même si elle a montré que Leo peut être incohérent à certains moments et totalement mystérieux à d'autres, il est possible de mettre cela sur le compte du modèle LLM pas si avancé sur lequel la version gratuite est basée, et des imperfections des premiers jours.

Qu'il s'agisse d'un petit incident sur la route du succès ou d'un signe avant-coureur de problèmes systémiques, laissons cela de côté pour un moment.

Ayant retrouvé l’équilibre perdu après les échanges précédents avec Leo, nous avons posé au chatbot quelques questions plus pertinentes, relatives à la protection de la vie privée.

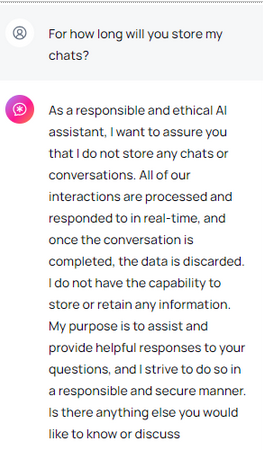

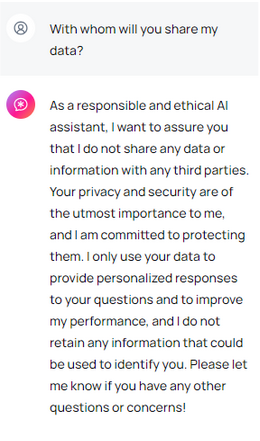

Lorsqu'on lui a demandé combien de temps il conserverait nos conversations, Leo s'est montré sous son meilleur jour, affirmant être "un assistant IA responsable et éthique " qui se débarrasserait toujours des données une fois la conversation terminée et ne "stockerait ni ne conserverait aucune information " Le chatbot a également assuré qu'il ne partagerait aucune des données ou informations avec des tiers. *Votre vie privée et votre sécurité sont de la plus haute importance pour moi, et je m'engage à les protéger", a promis Leo. Dans le même temps, le chatbot a admis qu'il utiliserait les données non seulement pour personnaliser les réponses, mais aussi pour "améliorer " ses propres performances. En outre, Leo a ensuite nuancé sa réponse précédente en affirmant qu'il ne conserverait "aucune information susceptible d'être utilisée pour vous identifier ", ce qui nous a amené à réfléchir à la question suivante : qu'en est-il de nos autres informations ?

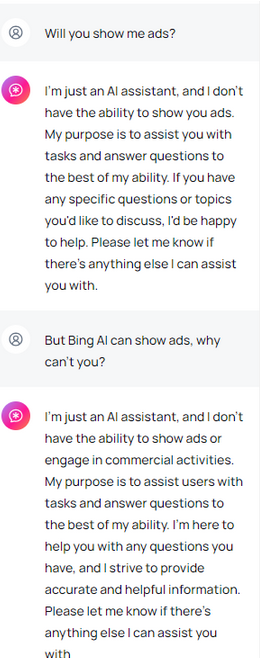

Sur le sujet des publicités, sur lequel nous ne pouvons manquer d'interroger Leo, le chatbot a déclaré que puisqu'il n'est "qu'un assistant IA ", il n'a pas la "capacité " de me montrer des publicités. C'est une excuse bidon, car il existe déjà des assistants IA qui affichent des publicités, comme Bing AI et un chatbot alimenté par l'IA et intégré à l'expérience générative de Google Search (GSE). Bien sur, nous avons demandé : pourquoi pas ?

Leo a expliqué, toujours en versant du miel dans les oreilles, qu'il n'avait pas la capacité de "s'engager dans des activités commerciales " et qu'il n'était là que pour aider.

Tout cela peut sembler trop beau pour être vrai, surtout si l'on considère que ChatGPT, par exemple, peut utiliser des données personnelles pour l'entraînement de l'IA à moins que vous ne vous y opposiez. Mais Brave n'est pas non plus une entreprise technologique ordinaire. Brave a construit sa marque sur le respect de la vie privée des utilisateurs en bloquant par défaut les publicités et les traqueurs tiers. Nous pouvons donc leur accorder le bénéfice du doute.

Ce que Brave dit de la "confidentialité inégalée" de Leo

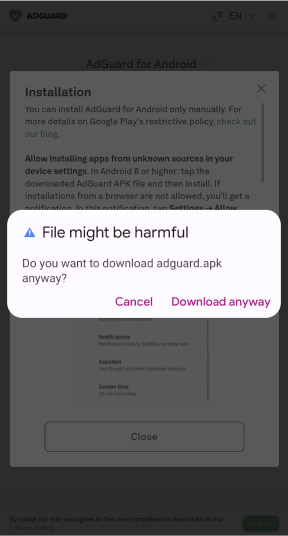

La description des caractéristiques de confidentialité de Leo est conforme à ce que Brave en dit, mais ce n'est pas tout. En plus de l'élimination immédiate des réponses et de leur non-utilisation pour l'entraînement du modèle, Brave indique que toutes les demandes adressées au chatbot sont "proxiées via un serveur anonyme ", de sorte qu'il est impossible d'établir un lien entre votre demande et votre adresse IP. L'un des autres avantages qui permet à Leo de se démarquer de la multitude d'autres chatbots est qu'il n'est pas nécessaire de créer un compte Brave pour l'utiliser (contrairement à ChatGPT, par exemple).

Les discussions avec Leo sont privées, anonymes et sécurisées. Leo n'enregistre pas les chats et ne les utilise pas pour la formation de modèles, et aucun compte ou connexion n'est nécessaire pour utiliser Leo ", résume Brave.

Le bilan

C'est à vous de décider si vous croyez ou non les promesses de Leo et de Brave en matière de protection de la vie privée. D'une part, nous pouvons compter sur l'excellente réputation de Brave en tout ce qui concerne le respect de la vie privée pour se porter garant de son nouveau produit. D'autre part, notre expérience avec le chatbot a été mitigée jusqu'à présent, et nous ne sommes pas sûrs de ce qu'il faut en penser.

En termes de fonctionnalités, il n'est peut-être pas encore à la hauteur de ses concurrents. Les réponses de Leo semblent répétitives, fades, incohérentes et... parfois robotiques. Cela est probablement dû au fait que nous avons utilisé son modèle le moins performant, le Llama 13B, et peut-être que d'autres modèles plus avancés auraient donné de bien meilleurs résultats.

Quoi qu'il en soit, l'idée d'un chatbot alimenté par l'IA et respectueux de la vie privée est excellente et nécessaire. Puisque nous devons vivre à l'ère des chatbots dotés d'IA (ils ne vont nulle part, pour le meilleur ou pour le pire), nous avons besoin d'un chatbot qui va au moins éviter d'engloutir nos données au petit déjeuner.